Как проверить позиции сайта и собрать семантическое ядро с помощью XMLRiver, Топвизора, KeyAssort и др

Проверка позиций сайта и сбор семядра с помощью XMLRiver (парсера Яндекса и Google)

Уж не знаю, почему, но моя муза, наверное, улетела отдыхать на моря. Авторское вдохновение потихоньку иссякло, и я не могу нарыть тем для новых материалов. Поэтому пришло время потрусить поисковики. Но парсинг выдачи поисковых систем – дело заковыристое. Приходится с прокси мучиться или десятки капч решать… На что товарищи по цеху говорят, что я отстал от времени и предлагают догнать прогресс с помощью XMLRiver.

В чем сложность парсинга в Яндексе и Гугле

Google и другие поисковые системы всячески борются за повышение релевантности выдачи. Но тогда почему сбор семантического ядра, его оптимизация или снятие позиций сайта превращается для вебмастера в танец с бубном. Причем такие пляски продолжаются уже не первый год. И я, видимо, уже привык осуществлять парсинг Google под свой танец – обходя блокировки поисковиков с помощью прокси и антикапч.

Но, видимо, практикуемый вашим покорным слугой способ давно устарел. О чем не раз уже намекали мои сотоварищи. И вот представился случай постичь более прогрессивный метод парсинга – с помощью XMLRiver.

Как в этом помогает XMLRiver

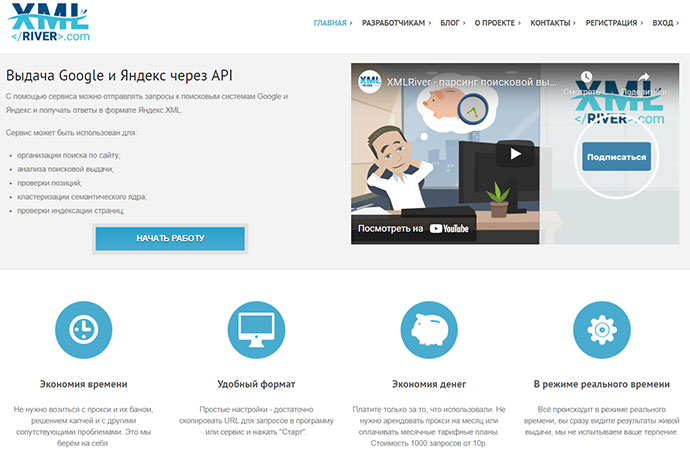

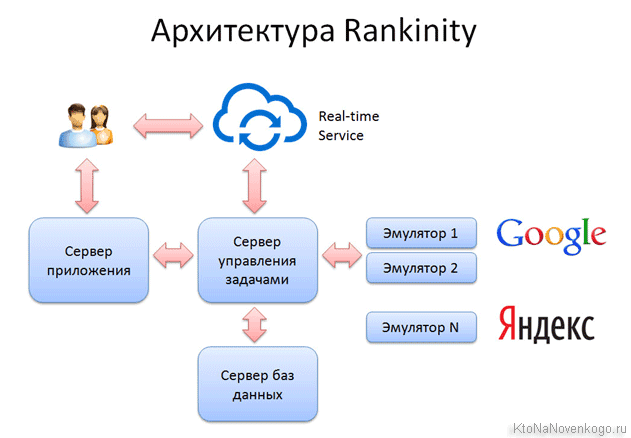

Парсер поисковой выдачи Гугла и Яндекса позволяет осуществлять выборку данных из SERP в формате XML. Его механизм схож с принципом работы Яндекс.XML. Но в отличие от него XMLRiver предоставляет прямую выдачу и как следствие, расширенный набор настроек, позволяющих сегментировать получаемые данные по множеству параметров.

Сервис можно использовать для:

- Проверки наличия веб-страниц сайта в поисковом индексе.

- Снятия позиций.

- Глубокого анализа поисковой выдачи по заданным запросам.

- Сбора семантического ядра.

- Сбора данных для кластеризации СЯ.

Его преимущества по сравнению с конкурентными решениями:

- Возможность парсинга не только органических результатов поиска, но и отдельных блоков выдачи (колдунщики, быстрые ответы и т.д.), а также Google News, Google Images и Google Shopping.

- Анализ рекламных объявлений конкурентов.

- Скорость сбора данных по Google превышает 15 тысяч запросов в час.

- Сбор данных с сервиса можно осуществлять с помощью бесплатной программы XMLRiver.Parser с последующей выгрузкой данных в CSV формате.

Нативный API сервиса без проблем интегрируется с популярным специализированным ПО и веб-приложениями, осуществляющими парсинг выдачи основных поисковых систем.

*при клике по картинке она откроется в полный размер в новом окне

Схема работы с XMLRiver:

- Регистрируемся.

- Пополняем счет.

- Настраиваем параметры гео и необходимые опции.

- Копируем URL для запросов.

- Вставляем в используемую программу ключ API и осуществляем беспроблемный (без капч и блокировок) сбор данных из результатов поиска.

Услуги сервиса предоставляются в виде подписок с оплатой за каждый запрос. Стоимость одного кило запросов к Google стартует от 10 руб., к Яндексу – от 8 руб.

А теперь проверим, насколько рассматриваемый сервис удобен и полезен для решения насущных проблем вебмастера…

Как начать парсить выдачу Google и Яндекса с помощью XMLRiver

Быстрый и беспроблемный парсинг Гугла мне нужен, чтобы найти тематические форумы для проставления ссылок, нынче это называется крауд-маркетинг. Для этого в связке с XMLRiver будет трудиться программа XMLRiver.Parser.

Что да как делаем (пошагово):

- Регистрируемся на сайте.

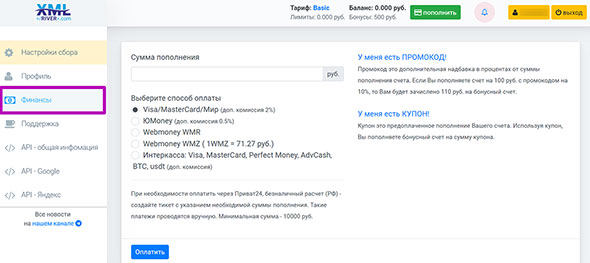

- В личном кабинете пользователя сервиса переходим в раздел «Финансы» и пополняем счет любым удобным для нас способом. Даже можно и криптовалютой.

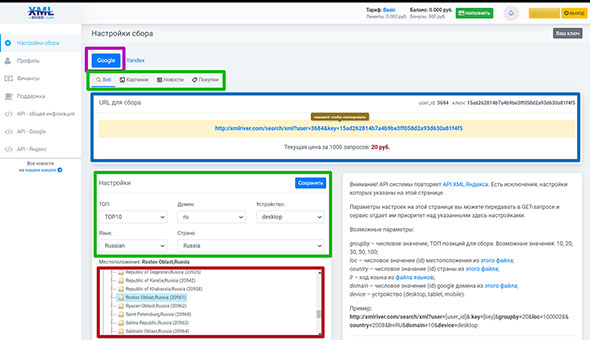

*при клике по картинке она откроется в полный размер в новом окне - На вкладке «Настройки сбора» выбираем поисковик, тип выдачи (органика, поиск по картинкам, новости или покупки). В нашем случае это будет Google органика.

*при клике по картинке она откроется в полный размер в новом окне - Перед тем как парсить выдачу Google, в настройках устанавливаем охват выборки по ТОПу, доменной зоне, типу устройства, языку и гео. Ставим топ20, т.к. форумы, которые находятся дальше, ранжируются плохо и нам не нужны.

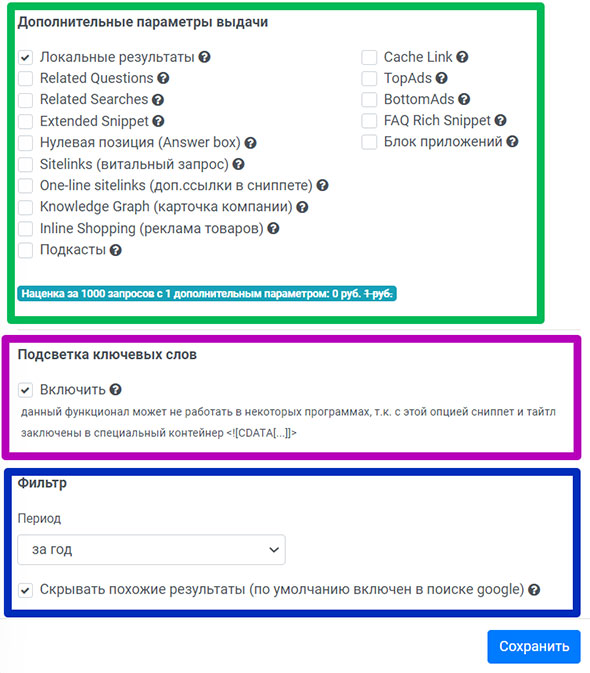

- В дополнительных параметрах указываем расширенные форматы выдачи и блоки SERP, которые нужно анализировать. А также (если нужно) активируем подсветку ключевых слов в выборке и задаем календарный период. Для нашей задачи всё это не надо.

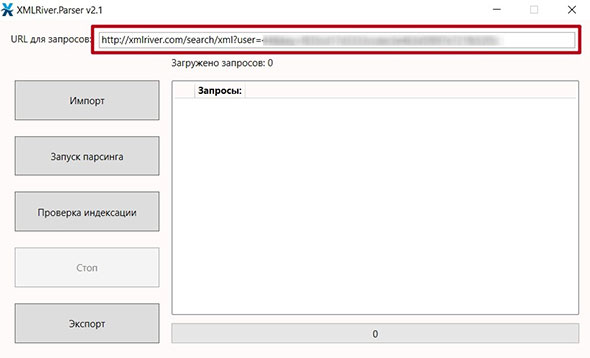

- Теперь осталось скопировать значение URL-адреса для сбора (см. скриншот выше) и вставить его в программу.

*при клике по картинке она откроется в полный размер в новом окне

Останавливаемся, чтобы проанализировать содеянное. Мы настроили параметры XMLRiver, которые позволят парсить выдачу Гугла в нужном направлении. И затем легко и быстро подключили сервис к сторонней программе.

Что дальше:

Нам нужны ключевые слова, по которым ранжируется наша страница, к каждому из которых мы добавим следующие конструкции:

- inurl:showthread

- inurl:viewtopic

- inurl:forum

- inurl:showtopic

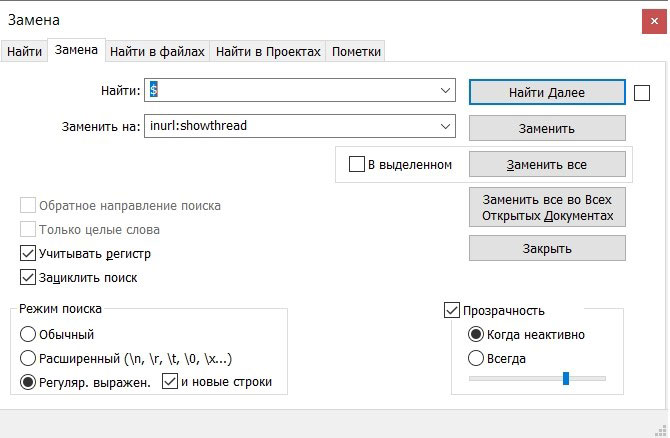

Сделать это проще всего в notepad++. Копируем список фраз в 4 разных документа (у нас 4 конструкции, которые надо добавить к фразам) и делаем замену, используя регулярное выражение (обратите внимание на режим поиска внизу окна):

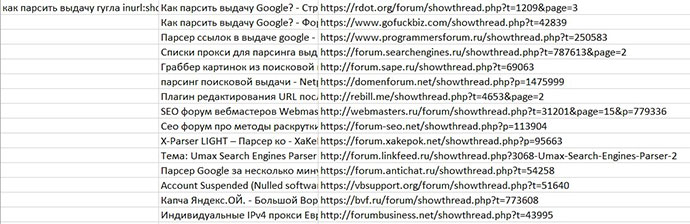

В результате данной замены получаем такой список:

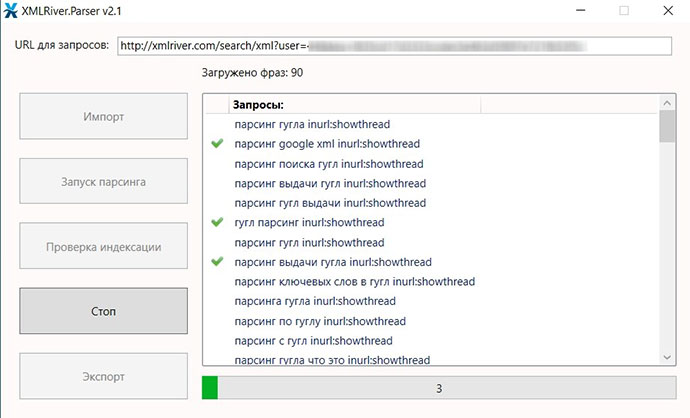

Проделываем тоже самое для трёх других конструкций и объединяем 3 списка. А дальше самое интересное – импортируем окончательный список фраз в XMLRiver.Parser и запускаем сбор данных:

*при клике по картинке она откроется в полный размер в новом окне

Дальше экспортируем полученные результаты и получаем самый сок, лучшие по мнению Google топики на форумах, где обсуждают искомую тему:

*при клике по картинке она откроется в полный размер в новом окне

Впечатления от работы приложения, интегрированного с XMLRiver:

Буквально за каких-то пять минут программа уже собрала из поисковой выдачи тысячи топов за очень скромный бюджет.

Насколько хорош XMLRiver?

По сравнению с более старыми способами XMLRiver позволяет намного быстреепарсить SERP в Гугл. Например, процесс сбора семантики занимает не несколько часов, а в среднем 20-30 мин. И при этом не нужно заморачиваться с заполнением проверочных капч от поисковиков или с подключением «антикапчевых» сервисов.

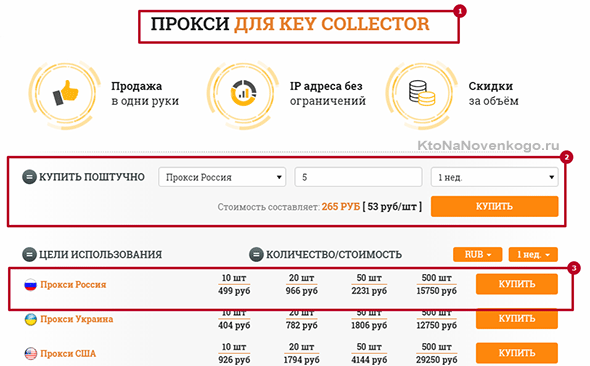

Конечно, для повышения эффективности анализа выдачи можно использовать прокси. Но с данным инструментом тоже не все так гладко. Ведь найти поставщика качественных proxy очень сложно. К тому же даже самые надежные айпишники обладают одним негативным свойством – не вовремя вылетать, сбоить и в разы замедлять скорость интернет-соединения. В результате процесс парсинга превращается в процедуру длиною в жизнь.

Да и стоимость использования антикапч и прокси тоже влетает вебмастеру в копеечку, что сопоставимо с оплатой услуг XMLRiver.

Тогда как парсить Google быстро, выгодно и без головной боли? Конечно же, с помощью XMLRiver. При тестировании возможностей сервиса я выделил следующие его преимущества:

- Простота интеграции – с ней справится даже новичок. Для интеграции инструмента со сторонней программой достаточно лишь вставить один URL для запросов.

- Большое количество настроек на борту – они позволяют указать гео и блоки выдачи, которые нужно парсить (при условии, что программа отображает дополнительные блоки выдачи).

- Обеспечивает бесперебойный режим работы.

- Охватывает все типы выдач Google – поиск по картинкам, товары, новости и обычный SERP.

- Низкая стоимость.

Горько это признавать, но я действительно отстал в своем профессиональном развитии. Прокси и антикапчи – уже прошлый век. Сегодня все продвинутые SEO-специалисты и вебмастера парсят выдачу с помощью XMLRiver. Ведь это удобней, эффективней и выгоднее.

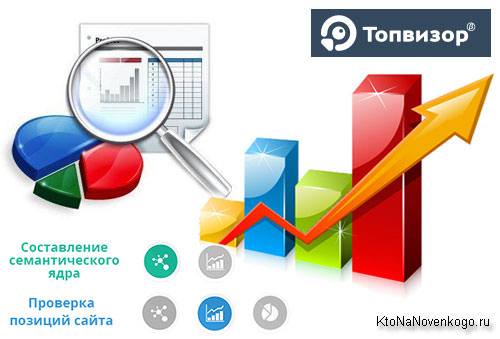

Топвизор — мониторинг и проверка позиций сайта

Хочу сегодня продолжить свои изыскания в области определения и дальнейшей периодической проверки позиций, занимаемых моим сайтом в поисковой выдаче популярных в рунете поисковиков. Полезно всегда быть в курсе и знать по каким запросам продвижение идет хорошо, а по каким пробуксовывает или даже откатывается назад, чтобы вовремя понять причину и принять меры.

Что примечательно, наш сегодняшний герой, имя которому Топвизор, умеет не только снимать позиции, но и предлагает собрать для вас семантическое ядро, т.е. помогает подобрать те самые ключевые слова (будущие поисковые запросы), по которым вы и будете продвигаться в дальнейшем.

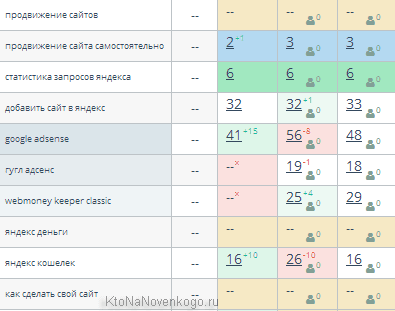

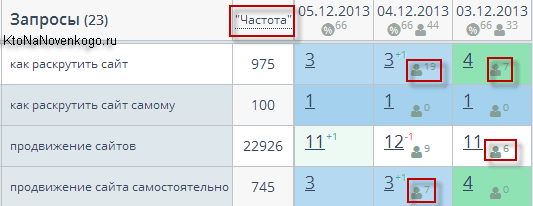

Кроме отображения ежедневной динамики изменения позиций вашего сайта (в выдаче Гугла, Яндекса и Майл.ру) и частотности этих запросов (точной или общей, по вашему усмотрению) Топвизор может показывать и тот трафик, что вы получили по каждому конкретному запросу в тот или иной день. Узнайте подробную информацию про Топвизор: цены, возможности, сравнение с конкурентами.

Есть и цветовая дифференциация в сводной таблице, которая визуально помогает оценить, насколько все хорошо и какие общие тенденции наблюдаются. Кроме этого недавно у них появилась возможность снимать позиции в Яндексе (а вскоре и в Google) бесплатно. Каким образом, спросите вы? Ну, позволю себе создать интригу и сказать, что об этом вы прочитаете в продолжении данной публикации.

Возможности онлайн сервиса TopVizor

Думаю, что прежде, чем приступать к детальному описанию всех возможностей данного онлайн сервиса, следует вкратце описать все имеющиеся на данные момент в нем особенности. Что примечательно, новый функционал появляется у них с завидной регулярность, что не может не радовать.

- Запросы, по которым вы хотите отслеживать позиции, можно будет загрузить вручную (копипастом или из файла), а можно будет их подобрать прямо в окне Топвизора, причем стоить это будет сущие копейки. Другими словами, не отходя от кассы вы сможете набросать семантическое ядро либо для всего проекта, либо для отдельных статей.

При этом вам нужно лишь указать начальную фразу (основную), для которой в Вордстате будут скопированы обе колонки, а там же можно будет вытащить ключевые слова содержащие эту фразу из поисковых подсказок Яндекса, Google и Майл.ру. Получите целую гору ключевиков, которую затем просеете с помощью двух расположенных ниже пунктов. - По всем вводимым вами запросам можно проверить их частотность по Яндекс Вордстату, причем доступна не только общая частотность, но и с отсеиванием пустышек (точная). Благодаря этому вы сможете выкинуть из собираемого семантического ядра все бесперспективные ключевые слова.

- Совершенно бесплатно вместе с частотностью будет определена и цена клика в Яндекс Директе, которая обычно назначается для этого запроса.

Зачем это нужно? А чтобы понять, какие ключевые слова являются сильно конкурентными и, возможно, исключить их из семядра (во всяком случае, для своего информационного ресурса я именно так и делаю). - В Топвизоре ожно настроить съем позиций по запросу (вручную), либо автоматически (ежедневно в назначенный вами час или после апа Яндекса). На первых порах существования ресурса или в период его бурного продвижения самое то будет ежедневно мониторить позиции, а затем можно уже перейти на режим «от апа к апу» или же вообще «от случая к случаю».

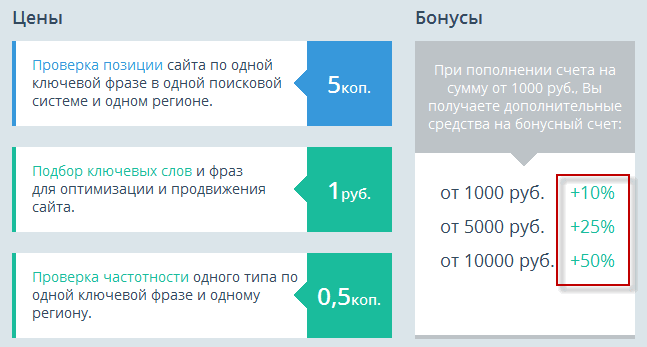

- Количество проверяемых запросов в ваших проектах никак не регламентируется, ибо плата взимается поштучно (одна проверка по одному ключевому слову в одной поисковой системе — пять копеек). Причем, при внесении на счет суммы, например, больше десяти тысяч рублей вы получить еще пять тысяч (или больше) в качестве бонуса и при большом количестве запросов стоимость их проверки может существенно снизиться (оптом дешевле).

- Для пробы пера вам на баланс сразу после регистрации зачисляется десяток рублей, что вполне достаточного для проверки позиций по двум сотням запросам или по чуть меньшему количеству, если вы еще решите сборку семядра потестить.

- Если вы захотите поделиться своими лимитами в Яндекс XML с Топвизором, то получите возможность ежедневно проверять определенное количество запросов бесплатно. Например, для моего блога это число будет равно 390, а о том, как узнать сколько будет отмерено халявки именно вашему сайту, читайте чуть ниже по тексту.

Имеется возможность открыть доступ Топвизору к данным вашего аккаунта в Яндекс Метрике и Вебмастере, чтобы видеть, сколько именно посетителей пришло к вам по данному конкретному поисковому запросу (очень наглядно и может заставить задуматься о настройке более привлекательного сниппета или тайтла).

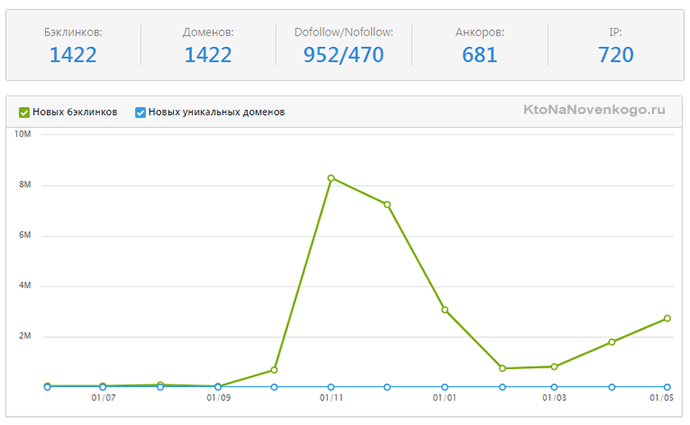

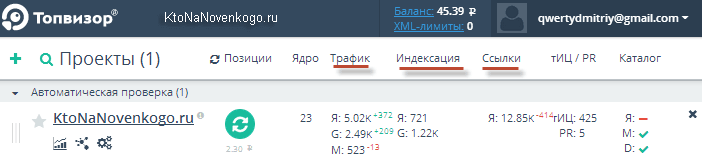

При этом еще и в сводной статистике по вашему сайту сможете видеть число посетителей пришедших с трех основных поисковых систем рунета за последние сутки, отслеживать динамику изменения числа проиндексированных страниц и количества обратных ссылок ведущих на ваш ресурс.

- Если структура вашего сайта такова, что вы используете поддомены, то вовсе не обязательно будет создавать для каждого из них новый проект — достаточно поставить всего лишь одну галочку при добавлении основного домена.

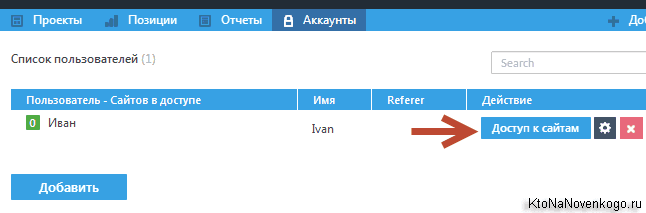

- Сео конторам и фрилансерам может показаться удобной опция предоставления гостевого доступа к аккаунту в Топвизоре с довольно-таки гибкой системой настроек возможностей гостя. При необходимости можно даже полностью передать аккаунт в руки другому пользователю, достаточно только указать его Емайл в этом сервисе по онлайн проверке позиций и сборке семантического ядра.

- Ну и, кончено же, отчеты.

Их можно будет сформировать либо вручную на странице просмотра динамики позиций, либо настроить их автоматическую отправку на указанный Емайл еженедельно или же ежемесячно. - В Топвизоре действует реферальная программа с очень даже высоким процентом отдачи — 10% от сумм, потраченных привлеченными вами клиентов. У них уже имеются рекламные материалы в виде баннеров наиболее популярных размеров, выполненных в цветовой гамме основного сайта, что вполне логично.

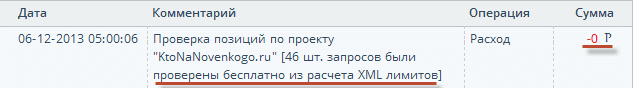

Естественно, что прежде вам нужно будет зарегистрироваться, а потом достаточно кликнуть мышь по баннерочку нужного размера и его код автоматом упадет в ваш буфер обмена с уже зашитой в нем реферальной ссылкой. Лепота. - По всем произведенным в сервисе платным операциям ведется журнал, где можно увидеть отчет по каждой копеечке. Пополнить баланс можно традиционными Вебманями и Пайпалами, а через Робокассу всем остальным. Для индивидуальных предпринимателей, ООО и всех желающих будет возможен ввод сумм больших пяти тысяч рублей по безналу.

Регистрация в TopVizor, добавление сайта и настройка проекта

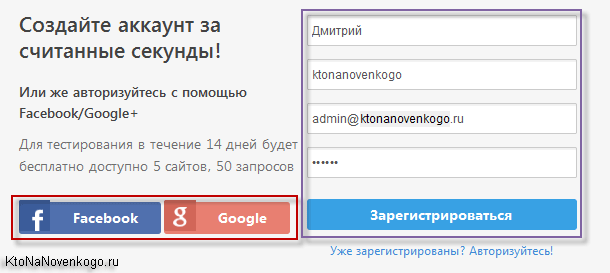

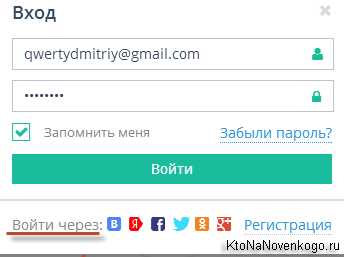

Ну, а теперь поговорим об этом поподробнее. Как театр начинается с вешалки, так и работа в онлайн сервисе — с регистрации. Для этой цели служит расположенная в верхней части окна главной страницы Топвизора кнопка «Регистрация».

Достаточно будет указать свой Емайл и вас автоматически авторизует в Топвизоре (пароль потом пришлют на указанный почтовый ящик).

При желании вход можно будет осуществить и без регистрации — с помощью аккаунта в одной из используемой вами соцсетей (сработает только в том же браузере, где вы залогинены в социальной сети).

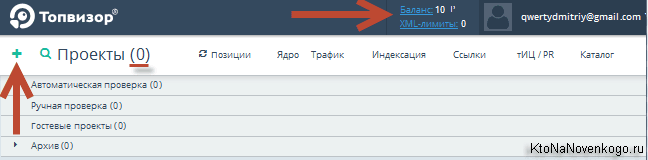

Первое, что вы увидите после авторизации на topvisor.ru — это страницу с данными по вашим проектах, которых, собственно, пока еще нет. Зато будет иметь место 10 рублей на балансе, что позволит протестировать возможности данного сервиса.

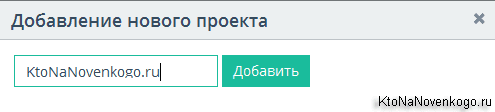

Создадим же не мешкая свой первый проект в Топвизоре простым нажатием на имеющийся в левой верхней части окна плюсик. Вам будет предложено ввести доменное имя исследуемого сайта:

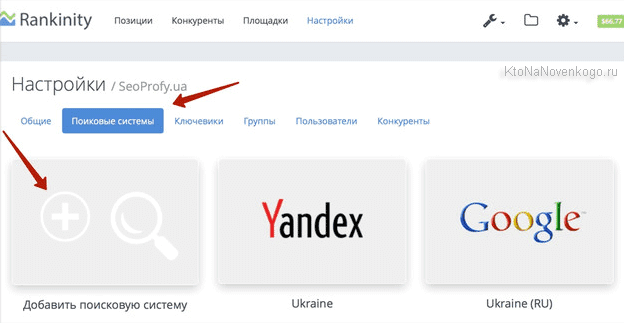

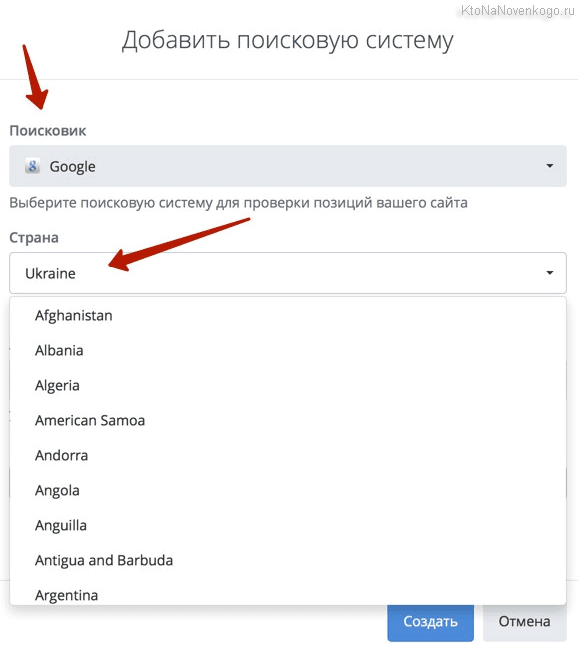

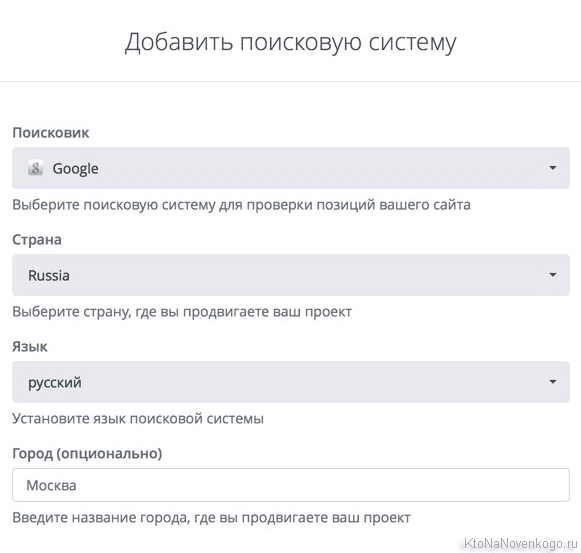

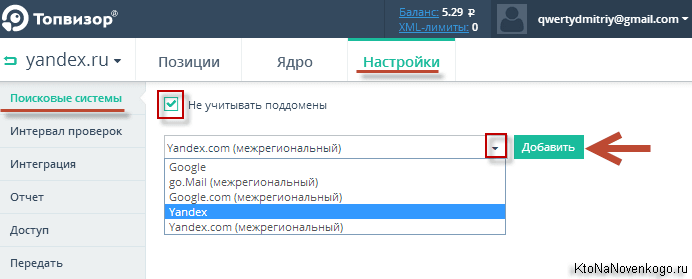

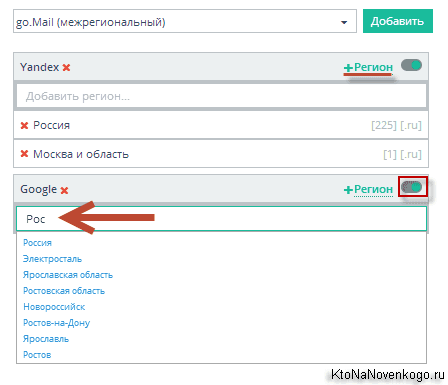

После этого вам незамедлительно предложат выбрать те поисковые системы (из трех возможных), в которых вы планируете снимать позиции для данного сайта. Извиняюсь, пока писал начало этого обзора, в интерфейсе Топвизора, кроме традиционных Яндекса, Гугла и Go.mail, появились в выпадающем списке межрегиональные Yandex.com и Google.com.

Чтобы добавить поисковик нужно будет воспользоваться расположенной справа кнопкой. Причем, если добавлять обычные Яндекс и Гугл, то для них еще потребуется выбрать регион, для которого потом и будут сниматься позиции. Регионов можно выбрать при необходимости несколько, но для каждого из них позиции будут сниматься за отдельную оплату.

Как вы знаете, есть запросы геозависимые и нет (например, «доставка пиццы» и «поэзия Пушкина»). В первом случае все понятно, а вот во-втором нужно выбирать именно тот регион, в котором вы хотите посмотреть позиции по данному запросу, либо любой другой, т.к. если запрос геонезависимый, то выдача различаться не должна. Например, лично я для мониторинга таких проектов использую регион «Россия».

Красные крестики служат для удаления поисковой системы или ненужного региона, а переключатель справа — для временной отмены съема позиций по данному поисковику. У межрегиональных Go.mail, Yandex.com и Google.com региона выбирать не потребуется. Обратите внимание, что кнопки Сохранить нигде нет, ибо все применяется на лету, что достаточно необычно, но прикольно.

Да, еще хочу сказать, что именно здесь вы можете снять пресловутую галочку «Не учитывать поддомены», чтобы реализовать упомянутую чуть выше по тексту возможность (не добавлять все поддомены по отдельности).

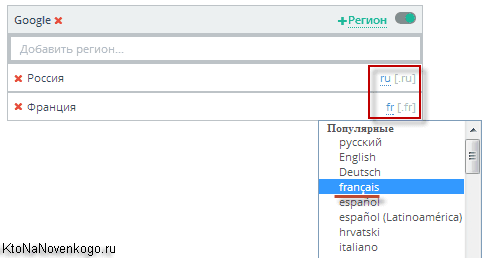

И еще обратите внимание, что для поисковой машины Google имеется возможность задать язык интерфейса (поисковой выдачи):

Зачем это нужно? Для проверки позиций в буржунете. Если я буду пробивать запрос на французском языке в регионе Париж с русским интерфейсом и французским, то выдача будет отличаться. Если нас интересует выдача для коренного жителя, живущего во Франции, а не русского туриста, находящегося в Париже, то нам надо выбирать именно французский интерфейс (выдачу на этом языке).

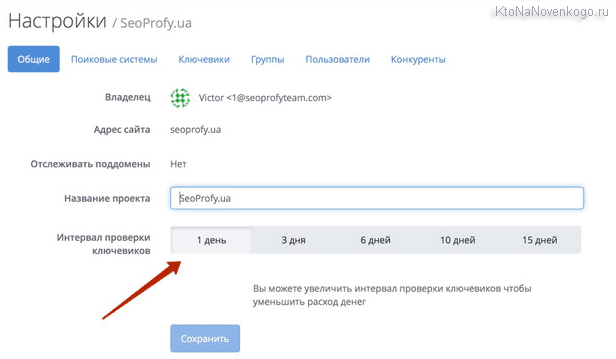

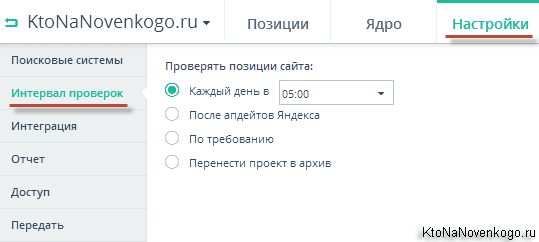

Давайте пробежимся также и по остальным настройкам в интерфейсе Топвизора, раз уж мы тут оказались волею судеб. Следующая вкладка называется «Интервалы проверок» и тут вы можете выбрать один из трех основных вариантов (ежедневное снятие позиций в нужный вам час, после апдейта Яндекса или же вы сами решите, что пришло время узнать правду), а так же можно вообще приостановить работу по данному проекту (перенести его в архив) в силу каких-то причин.

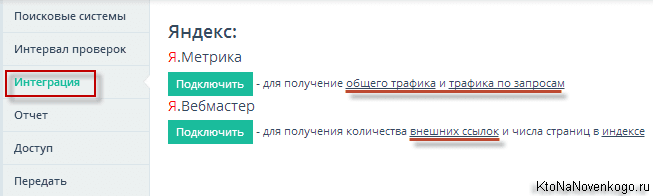

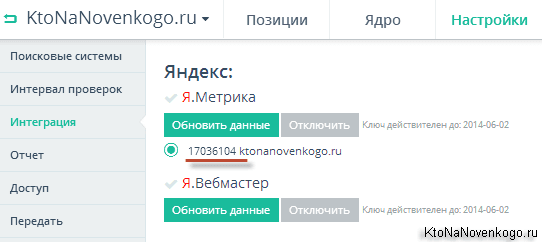

Далее у нас на очереди вкладка «Интеграция». Тут вы вольны будете настроить выгрузку статистики из Яндекс Метрики в Топвизор, ну и из Yandex Webmaster тоже можно получить некоторые данные. Если у вас оба этих сервиса завязаны на один аккаунт Яндекса, то подключив один из них, второй подключится автоматически.

После интеграции будет отображаться номер вашего счетчика в Метрике, а также будет возможность принудительно обновить данные, подгружаемые с этих сервисов (обычно они раз в сутки обновляются автоматически).

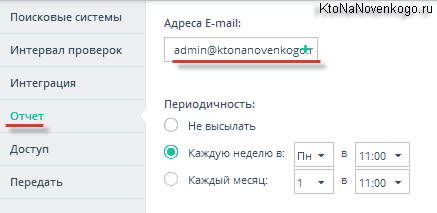

Как я уже упоминал, при желании вы можете настроить еженедельное или ежемесячное получение отчетов о снятых позициях в виде CSV файла на указанный тут Емайл (для вас самих или для клиента, которому вы подвязались продвигать сайт):

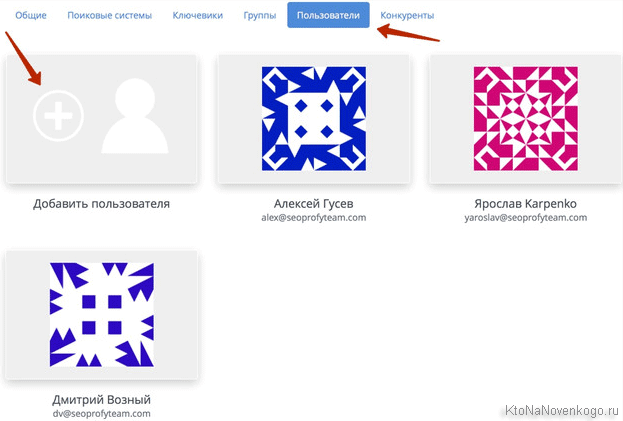

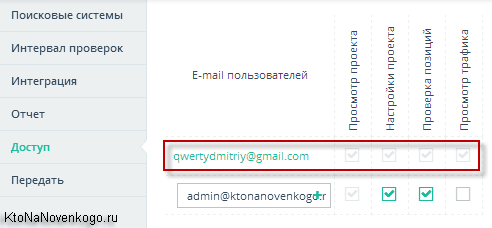

На вкладке «Доступ» вы сможете добавить Емайл адрес того респондента, которому хотите предоставить полные или урезанные права на управление данным проектом (ваш основной Емайл по умолчанию будет наделен максимальными полномочиями). Единственное что, этот пользователь должен быть зарегистрирован в Топвизоре.

Ну и, наконец, на последней вкладке настроек сможете передать управление данным проектом по съему позиций для данного сайта какому-то другому пользователю данного сервиса, Емайл которого и нужно будет указать в имеющейся там форме.

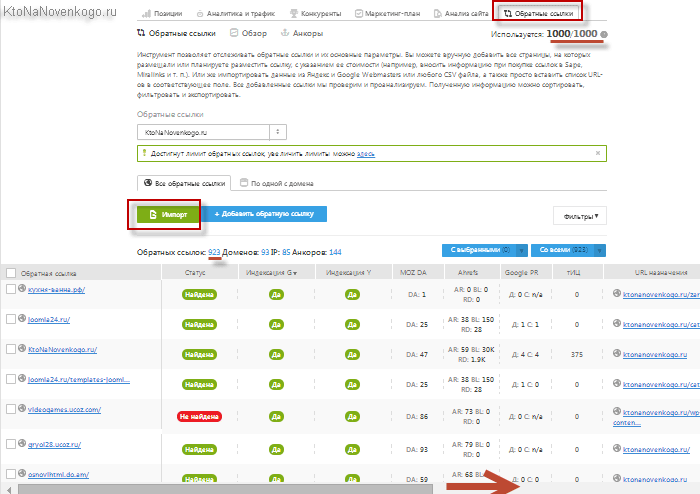

Но это еще не все. Помните я говорил о возможности бесплатно определять позиции при помощи передачи своих лимитов из Яндекс.XML. Что это такое?

Ну, если говорить про XML от зеркала рунета, то его можно сравнить с ранее описанным мною поиском для сайт от Яндекса, но в случае использования XML серьезно повышается гибкость и варианты использования этой версии поиска (например, все та же поисковая системе Нигма использует эту технологию для доступа к базе Яндекса).

Но не суть. Главное понимать, что выдача в Яндекс.XML практически идентична выдаче основной (отличия проявляются обычно только на кануне очередного апдейта), а значит она вполне подойдет для проверки позиций.

Но XML для Топвизора является резервным вариантом, на случай, когда съем позиций с основной выдачи по форс мажорным обстоятельствам будет не возможен. Чтобы не нагружать свои сервера в Яндекс.XML имеют место быть лимиты на количество запросов, которые выделяются каждому сайту, желающему использовать эту технологию. Своих собственных лимитов у Топвизора, естественно, не хватит на нужды всех его пользователей.

Однако, лимиты можно передавать официальным путем. Поэтому вам и предлагают передать не нужные вам лимиты, а взамен получить определенное количество бесплатных проверок позиций (10% от числа переданных лимитов). Еще раз обращаю внимание, что квоты на использование XML будут задействованы в Топвизоре только в случае форс мажора, а позиции снимать бесплатно вы сможете хоть каждый день.

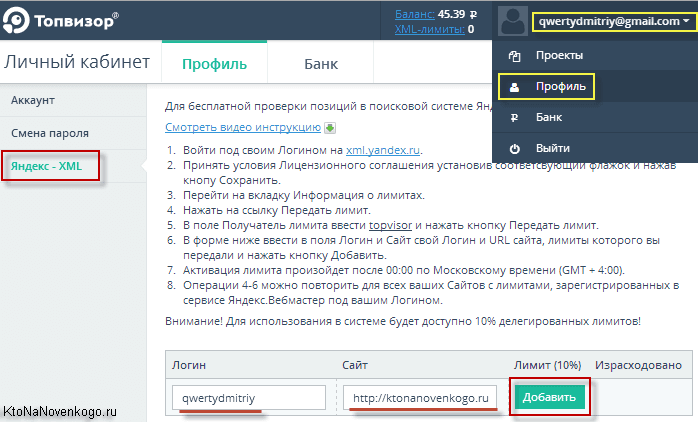

Для того, чтобы узнать выделенные именно вам лимиты, перейдите на эту страницу, поставьте галочку в самом низу о принятии условий и, перейдя на вкладку «Информация о лимитах», сможете узнать пределы выделенные для тех сайтов, что у вас висят на этом аккаунте в Яндекс Вебмастере:

Для передачи лимитов служит приведенная там ссылочка. Инструкция по передачи находится на вкладке «Яндекс-XML» (из контекстного меню вашего логина нужно будет выбрать пункт «Профиль»).

На этой странице Топвизора вам нужно будет указать свой логин в Яндексе и Урл того сайта, чьи лимиты вы передали.

Все, десять процентов запросов от общего числа переданных лимитов (в моем случае это 370) можно будет пробивать каждый день бесплатно, что не может не радовать.

Добавление запросов и подбор семядра средствами TopVizor

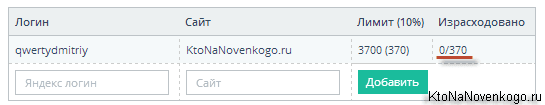

Все, с настройками покончено и пора переходить к очень интересной возможности этого онлайн сервиса, а именно к подбору семантического ядра. Для этого нужно будет из верхнего меню перейти на вкладку «Ядро». Тут вас ждет серый квадрат Малевича, на котором красуется большой знак плюс. Замечательно, именно по нему и кликаем мышью.

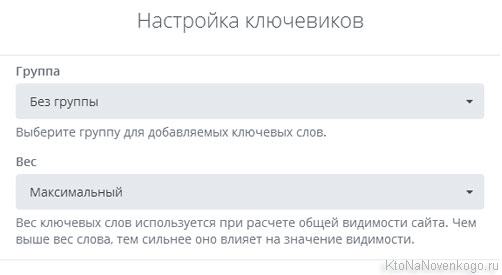

На приведенном скриншоте уже был создана одна группа с поисковыми запросами, по которым потом будут сниматься позиции, но вы на это не смотрите. После клика по плюсику, слева от него появится пустая форма с названием «Новая группа». Дважды кликнув по этому названия мышью вы получите возможность его изменить.

Сразу оговорюсь, что кликнув по зеленой точке рядом с названием группы запросов, вы эту самую точку перекрасите в красный цвет, что повлечет за собой прекращение съем позиций по данной группе. Но нам в данный момент интересны способы заполнения появившейся формы ключевыми словами, имеющими отношение к нашему сайту.

Есть несколько вариантов добавления запросов для проверки в Топвизоре:

- Вы можете вводить по одной ключевой фразе в поле «добавить запрос» в самом низу открывшейся формы и жмякать на расположенный рядом маленький плюсик. Ключевик запрыгнет в форму и останется там жить, пока вы не нажмете на появляющийся слева от него крестик или не перетащите его мышью в другую группу запросов на этой же странице.

Перетащить мышью можно будет и все содержимое формы, ухватив его за расположенный в нижнем правом углу значок (см. на скриншоте). Если у вас уже имеется готовый список ключевых слов (у меня, например, он есть и я периодически проверял позиции по нему в Site-Auditor, но проблема была в том, что список этот содержал тысячи ключей и на съем уходило несколько дней ручного труда), то кликните по второй иконке из расположенной слева вверху панели инструментов.

На ней еще нарисовано облачко со стрелочкой вверх и она выделена на обоих верхних скриншотах. Нашли? Замечательно.

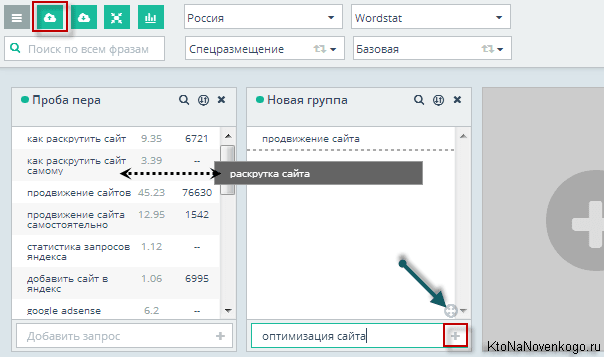

В открывшемся окне у вас будет опять же две возможности: либо методом копипаста через буфер обмена вставить уже готовый список ключевиков в приведенную форму (по одному ключу в стоке), либо загрузить уже готовый файл, в котором запросы представлены в таком же виде.

Обратите внимание, что в нижней части окна вы вольны не только выбрать одну из уже существующих групп ключевых слов, но и создать новую, что может быть иногда полезно. Ну, и кнопку «Загрузить» нажать не забудьте.

Третий способ вам может пригодиться тогда, когда вы еще, например, только планируете написание статьи на определенную тему, но еще не совсем уверены под какие именно поисковые запросы вы ее будете оптимизировать, чтобы иметь шанс попасть по ним в Топ и что намного важнее — понять, будете ли вы получать по ним трафик вообще, даже в случае попадания в Топ1.

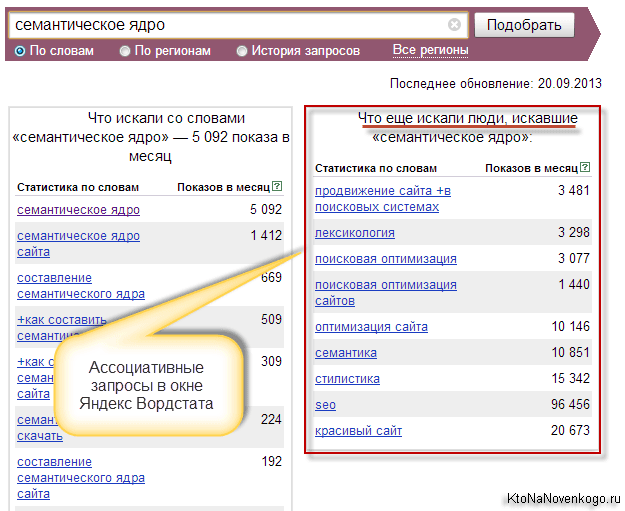

Другими словами нам нужно собрать и просеять от пустышек и бесперспективных запросов семантическое ядро. Обычно для этой цели у вебмастеров имеются два источника получения списка ключевых слов — статистика Яндекса под название Вордстат и поисковые подсказки Yandex, Гугла или Майл.ру, которые можно спарсить программным способом.

Собственно, TopVizor именно эти инструменты и предлагает вашему вниманию для сбора и расширения семядра. Ну, и еще он предлагает собрать частотность по всем этим запросам, а также определить цену клика в Яндекс Директе.

Если запрос окажется не востребованным (например, менее 20 вводов в выдаче за месяц), то его можно смело удалять из списка. Так же, если цена за клик в Директе по нему баснословная, то стоит задумать о перспективности траты средств на его продвижение.

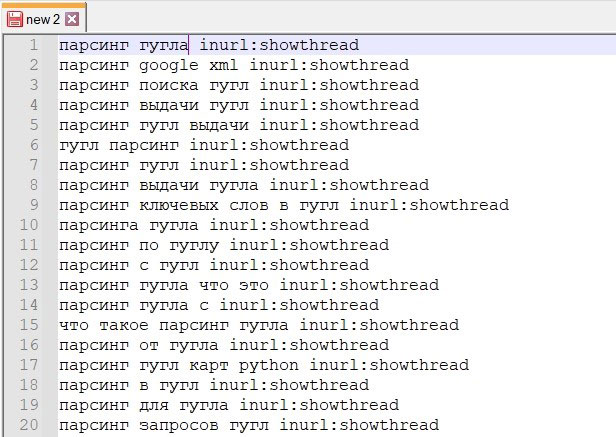

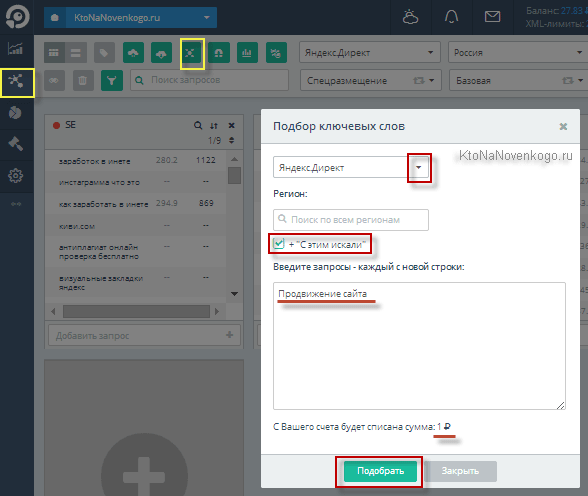

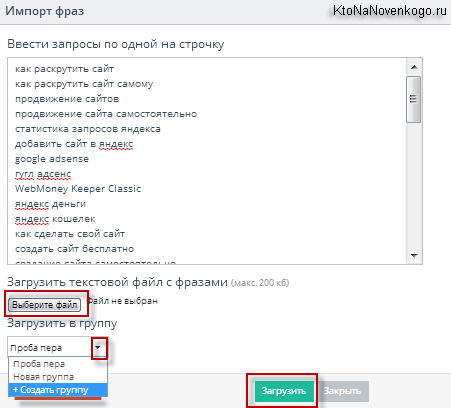

Посмотрим, как это все реализована на практике в Топвизоре. Для этого на панели инструментов вкладки «Ядро» нужно нажать на четвертую иконку, показанную на скриншоте:

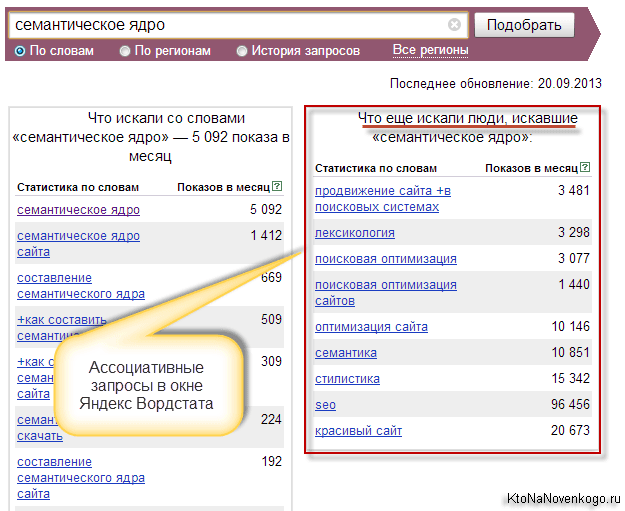

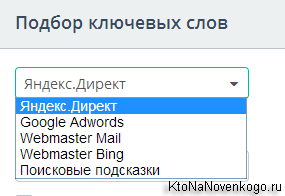

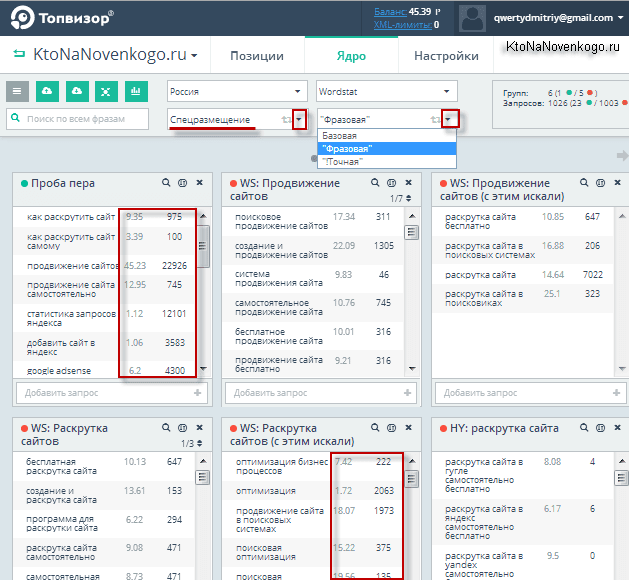

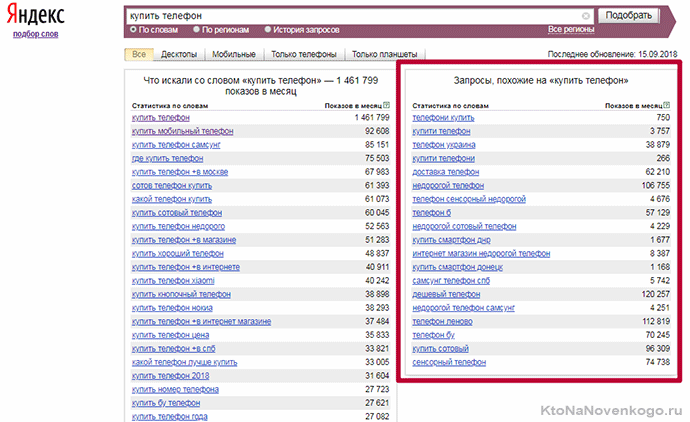

Появится окно с возможностью выбора области парсинга (Вордстат или поисковые подсказки). При выборе Вордстата у вас будет возможность собрать данные не только из левой колонки, но из правой, просто установив галочку «С этим искали».

Позволю себе напомнить, что в левой колонке Wordstat выводятся словосочетания включающие то, что вы задали в качестве отправной точки, а в правой отображаются ассоциативные запросы, которые пользователи задавали Яндексу в той же самой поисковой сессии.

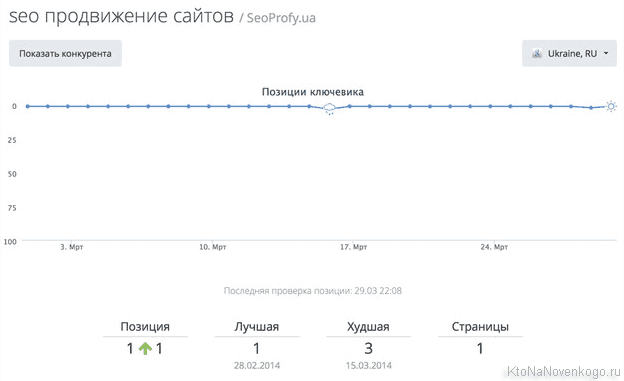

После начала парсинга у вас появятся несколько новых групп (для каждого начального запроса и для каждой колонки Вордстата), где в момент получения данных будет бегать змейка или начнет заполняться стакан фигурками из тетриса. По окончании процесса вы получите соответствующие списки:

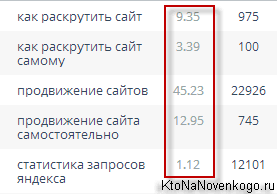

Например, для фразы «раскрутка сайтов» мы получили данные из левой и правой колонки Wordstat в показанном на скриншоте виде. Обратите внимание, что для некоторых из ключевиков уже показана частотность (вторая колонка цифр) и стоимость клика в Директе (первая).

Откуда они взялись, если мы ее не снимали? Просто эти данные уже оплатили другие пользователи Топвизора, а он нам любезно предложил воспользоваться цифирьками, хранящимися у этого сервиса в кеше. Чем больше будет пользователей, тем реже придется платить за съем частотности.

Нам же для полноты картины и начала дальнейшего анализа семантического ядра не хватает данных из поисковых подсказок популярных поисковиков рунета. По определению, это наиболее часто задаваемые поиску вопросы, которые и подсовываются всем подряд, чтобы облегчить труд по поиску нужных буковок на клавиатуре.

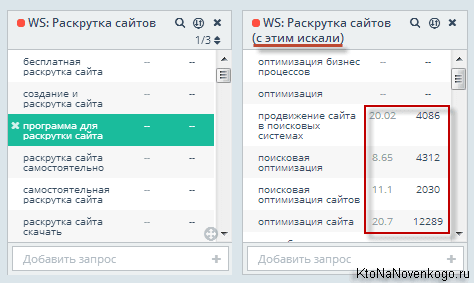

Парсинг подсказок в этой сервисе активируется той же самой четвертой кнопкой на панели инструментов вкладки «Ядро», но в открывшемся окне вам нужно будет выбрать другой вариант из выпадающего списка:

Можно собрать подсказки со всех поисковиков, а можно только с нужных вам. Кроме этого, чуть ниже можете выбрать глубину подсказок (от 1 до 3). Что это такое? Хороший вопрос, на который не так-то просто ответить словами, ибо это проще увидеть и услышать из уст популярного блогера:

Для каждого поисковика будет собрана своя группа запросов выдранных из подсказок. Обратите внимание, что стоимость парсинга, выводимая внизу формы, будет зависеть как от числа выбранных поисковых систем, так и от глубины подсказок. Варьироваться она может от десяти копеек до полутора рублей, что, в общем-то, совсем не много.

Проблематика сбора полноценного семантического ядра

Вполне логично, что сервис, осуществляющий мониторинг позиций сайта по различным ключевым запросам, может помочь эти самые запросы подобрать. Вообще, процесс сборки полного пула запроса весьма сложен. Как правило, многие оптимизаторы отделываются лишь сбором малой части ядра, тем самым существенно затрудняя путь к успеху своего сайта (читайте про пять основных ошибок при продвижение коммерческого сайта).

Наиболее полное ядро можно собрать, если использовать все имеющиеся для этого инструменты (а не только Yandex Wordstat). Можно, например, проанализировать те запросы, по которым на сайт уже приходят посетители (в Топвизоре это позволяет сделать «Магнит»), можно собрать ключи по всем возможным сервисам, предназначенным для рекламодателей контекстной рекламы, а также можно подключить поисковые подсказки и ключи, собранные в панелях поисковых систем для вебмастеров.

Однако, даже при полном охвате всего пула запросов по данной тематики (что, по большому счету, маловероятно из-за огромного «длинного хвоста»), этот список еще нельзя будет назвать полноценным семантическим ядром, ибо не решен главный вопрос. Заключается он в том, что же с этими самыми собранными запросами делать.

Можно попробовать отвести под каждый из них отдельную страницу и написать соответствующие тексты (читайте про 8 основных ошибок и 6 советов по оптимизации текстов для успешного продвижения сайта). Но это будет просто нерентабельно, да и практически не реализуемого для ядра в десятки или даже сотни тысяч запросов. Что же делать?

В общем-то, вариант только один — группировать запросы для оптимизации под отдельные группы отдельных страниц вашего сайта. Но при этом встает еще одни не менее важный вопрос — какие запросы можно объединять в группы, а какие нельзя?

Нужно понимать, что объединить-то нужно не просто по своему желанию, а чтобы они все сумели попасть в Топ (точнее в целый ряд Топов по числу объединенных запросов) при том, что размещены они все будут на одной странице. Поэтому вопрос сводится к следующему — какие запросы можно объединить на одной страницы без ущерба для их продвижения.

Есть разные методики (от аналитики до наития), которые используют составители семантических ядер. На мой взгляд, неплохим принципом может служить: одна проблема — одна страница с ее решением. Или что-то подобное. Но все же это гадание на кофейной гуще, ибо в Яндексе за это дело отвечает бездушная машина под названием Матрикснет, которая с человеческой логикой считается не всегда.

Однако, нам может помочь одна из пяти приведенных выше недоработок оптимизаторов — анализ конкурентов. Можно ведь внимательно посмотреть на тех конкурентов, которые попали в Топ по многим из продвигаемых вами ключевым словам, и проанализировать, какие именно группы запросов они объединяли на одной странице, чтобы повторить за ними, ибо это, априори, сработало по крайней мере один раз и может сработать снова.

Другое дело, что делать это все вручную крайне трудозатратно. Если с небольшим числом высокачастотных и среднечастотных запросов при должном подходе справиться можно, то низкочастотники, и уже тем более «длинный хвост» (сверх низкочастотные запросы) охватить вручную не получится, как ни старайся. Да и вообще, человеко-часам можно будет найти куда более лучшее применение, чем заниматься тем, что может сделать машина (программа или алгоритм).

Собственно, с недавних пор всю эту рутину взял на себя TopVizor. Сбор семантического ядра через него частично платный (за отдельные операции), но, по сути, это сущие копейки за такую работу. Ведь это основа для всего будущего и текущего продвижения сайта, без которой ничего достичь путного не получится. Давайте посмотрим алгоритм работы модуля «Ядро» в Топвизоре и отдельно остановимся на его изюминке — кластеризации запросов на основе выдачи Яндекс или Google.

Сборка семядра для сайта в TopVizor

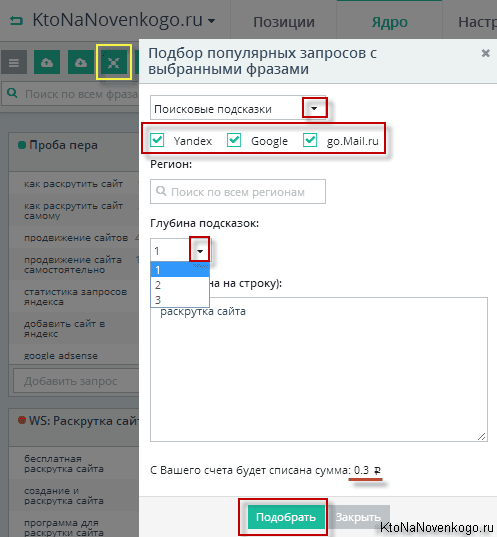

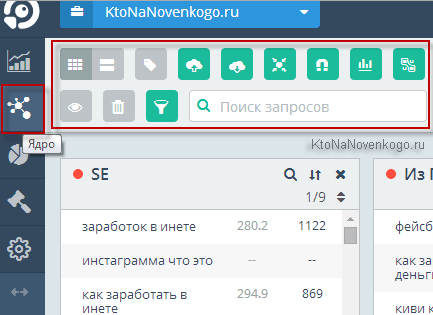

Итак, в интерфейсе сайта Топвизор переходите из левого меню на вкладку «Ядро» (вторая иконка сверху) и осматривайтесь.

За прошедший год набор инструментов в верхней панели существенно расширился (видимо, сказалась плотная работа с пользователями сервиса, которые высказывали свои чаяния и пожелания).

Добавилась, например, возможность переключения из режима просмотра «в виде блоков» (который используется по умолчанию) в режим «таблиц» (сдвоенная пиктограмма в начале панели инструментов). Блоки хорошо подходят для переброски ключевых слов между группами, а таблицы лучше подходят для изучения ключей внутри одной группы (больше данных отображается и повышается наглядность).

Далее идет иконка активирующая маркер (можно будет выбрать цвет для пометок определенных ключей в группах), а за ней находятся иконки для экспорта и импорта запросов. Примечательно, что запросы теперь можно импортировать (загружать) в виде списков с указанием групп, к которым должны принадлежать те или иные слова (формат записи в этих списках должен быть такой — «запрос;урл целевой страницы;название группы»).

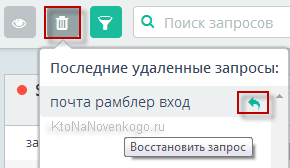

Еще несколько мелочей, которые существенно повышают удобство работы, на мой взгляд. Для удаления ненужного запроса достаточно подвести к нему курсор мыши и кликнуть по значку корзины, появившейся слева от него. Однако, все мы люди, а значит можем запросто удалить что-то нужное по неосторожности. Теперь в панели инструментов появилась кнопку «Корзина», где хранятся два десятка удаленных последними запросов, которые при желании можно будет восстановить.

Рядом с ней слева вы увидите кнопку с глазом, которая позволяет временно убрать с экрана не нужные вам в данный момент работы блоки (группы запросов), чтобы они не мешались занимая место и излишне запутывая вас. Удобно. Там же вы найдете иконку фильтра (с воронкой), которая поможет вам отфильтровать, например, только ВЧ запросы, если возникнет такая необходимость. Ну, и естественно строка поиска, куда можно начать вводить слова запроса и сразу видеть результат фильтрации.

Ну и, конечно же, заслуживает всех похвал реализация механизмов перетаскивания мышью ключевых слов внутри или между группами (для переноса всех запросов из блока подведите курсор к ее правому нижнему краю до появления обводки), а также выстраивание блоков (хватая их мышью за «шапку») в нужном вам порядке. Вместо использования кнопки «глаз» можно не нужные пока блоки с группами перетащить за область просмотра, создав тем самым второй экран, на который можно будет перейти по нажатию на появившуюся вверху точку (как в слайдерах). Удобно, очень даже.

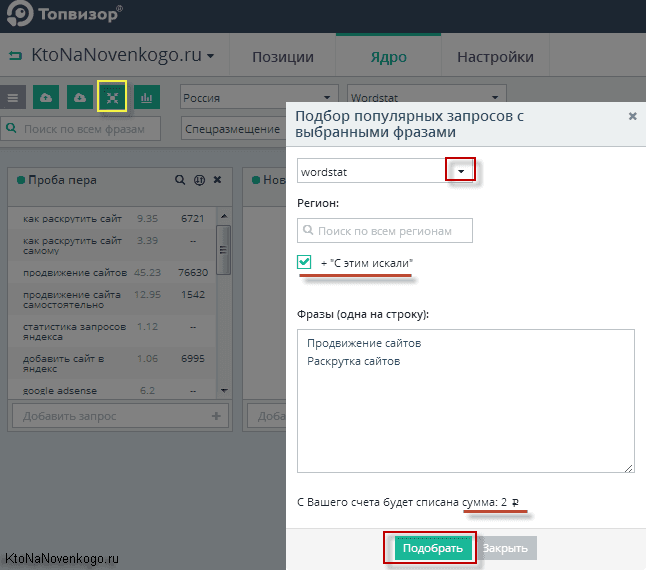

Собственно, пора начинать. Сбор ядра можно начать с инструментов поисковых систем, таких как Яндекс Вордстат, Google Keyword Planner и т.п. В Топвизоре все это можно сделать, нажав на кнопку «Подбор ключевых слов» в верхней панели инструментов.

Из выпадающего списка можно выбрать для начала Яндекс Вордстат (можно и галочку будет поставить, чтобы собирались данные не только левой, но и правой колонки Вордстата). В расположенной чуть ниже форме нужно будет вписать изначальные ключевые слова, от которых мы будем плясать. Где их взять? Из головы, у конкурентов или каким-то еще способом.

Каждый из этих начальных запросов (обычно это высокочастотник) будет прогоняться через Вордстат, и в результате вы получите десятки, сотни или даже тысячи образованных от него фраз, которые вводят пользователи поисковой системы Яндекс. Пока мы их все просто собираем, а чуть позже уже выявим пустышки и отбросим неподходящие еще по каким-либо причинам.

Если вы стремитесь собрать вообще все, что только можно, то кроме Вордстата стоит собрать ключи и из Google Keyword Planner (Адвордса), а также из панели вебмастерова Майл.ру и панели Bing. Кроме этого, кое-что полезное можно вытянуть и из поисковых подсказок (фраз, которые вы видите под поисковой строкой в момент набора запроса).

Повторяющиеся запросы, собранные в разных системах, Топвизор автоматически отсеет, что очень удобно. В итоге мы получим довольно приличный список уникальных запросов по интересующей нас тематики. Однако, не все возможные варианты изначальных ключей можно предусмотреть. Зачастую, что-то существенное остается за кадром. Поэтому нужно будет продолжить сбор ключей.

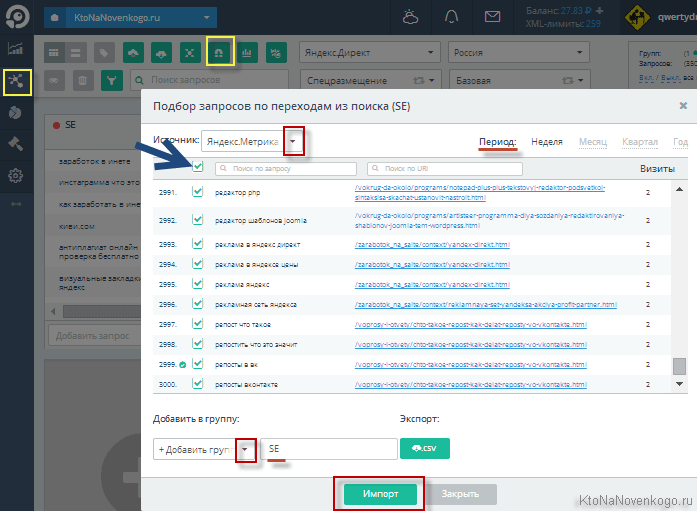

Для этого мы используем следующую иконку из верхней панели инструментов с изображением магнита. Называется она «Подбор ключевых слов по трафику из Я.Метрики и Google Analytics», что уже о многом говорит. Если вы еще не провели интеграцию с Метрикой и Аналитиксом, то прокрутите эту статью вверх и немедленно исправьте это упущение.

В открывшемся окне «магнита» можно будет выбрать статистику, из которой будут выдергиваться ключи, а также чуть правее выбрать период времени, за который будет осуществляться выборка.

Запросов будет, скорее всего, много. В моем случае выдается по три тысячи штук из каждой системы статистики (видимо, это потолок). Все их или только часть можно пометить галочками, после чего выбрать уже существующую группу (или ввести название для новой) и нажать на кнопку «Импорт». Все помеченные галочками ключи будут перемещены в нее и вы сможете начать с ними работать. Естественно, что выгрузка производится бесплатно.

Теперь у нас имеет огромная куча уникальных запросов соответствующих нужной тематике. Однако, не все из них одинаково полезны, ибо многие из них пользователи вообще никогда не используют при своем обращении к поисковым системам, а значит продвижение по ним совершенно не даст никакого результата. Так как же выявить эти самые «пустышки»?

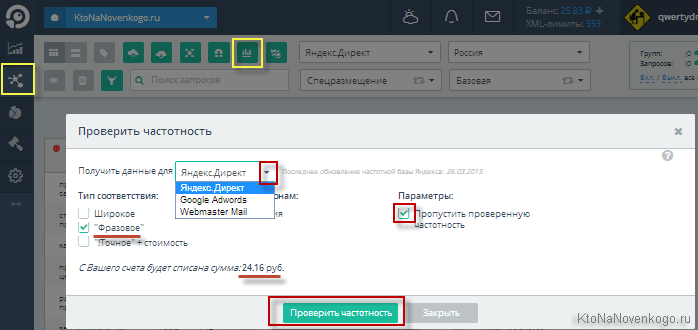

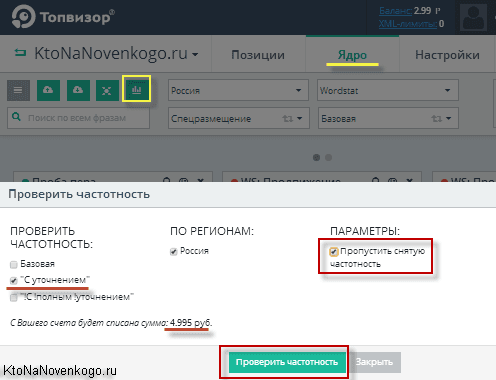

Довольно просто — нужно будет собрать по ним точную или фразовую частотность (читайте про операторы Вордстата). В Топвизоре для этой цели имеется отдельный инструмент, который можно активировать нажатием по иконке «Проверка частотности» на верхней панели инструментов:

«Пробивать» частотность можно по трем системам: Вордстату (Директу), Адвордсу и Вебмастеру Майл.ру. Широкое соответствие не позволит вам выявить пустышки, поэтому выбираем либо фразовое (учитываются запросы пользователей содержащие только эти слова и фразы, но в любой словоформе), либо точное (учитывается еще и словоформа — род, число, падеж). Также можете выбрать регион. Стоимость проверки будет зависеть от числа ваших запросов и типов частотности, которые вы хотите снимать.

Потом ставите фильтр, по которому отсеиваются запросы, имеющие частотность меньше заданной вами. Какой именно порог выбрать, зависит от тематики вашего сайта. Например, в недвижимости запрос с единичной частотностью может вполне привести к одной продаже в год, а это по-любому окупит расходы на его продвижение. В другой же тематике запросы ниже сотни могут быть не рентабельными в продвижении.

Ну, и теперь мы подошли к самому интересному. Если вы сделали все правильно, то в сухом остатке у вас сейчас имеется огромная куча ваших целевых запросов, которые желательно было бы использовать при продвижении. Но писать под каждый из них текст (отводить отдельную страницу) было бы верхом нерентабельности и расточительства. Поэтому их надо объединить в группы, под которые и будут оптимизироваться итоговые страницы вашего сайта.

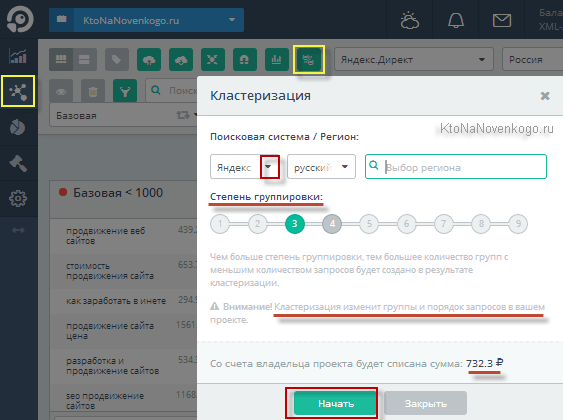

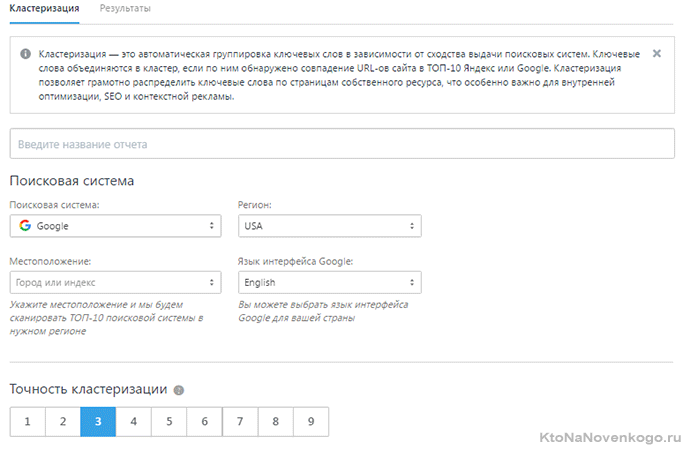

Автоматическая группировка запросов в Топвизоре

Вот как раз этого финального аккорда и не хватало в TopVizor, но теперь он появился. Это кнопочка «Кластеризация ядра» в верхней панели инструментов. Нужно понимать, что после выполнения кластеризации все созданные вами ранее группы буду разбиты, а запросы перемещены между вновь созданными.

В инструменте группировки вы можете выбрать поисковую систему, на основании данных которой будет осуществляться группировка. Что выбрать? Ну, очевидно тот поисковик, под который вы собираетесь продвигаться и штурмовать Топы. То же самое касается и региона (если вы его не выберите, то выборка будет осуществляться по региону Россия).

Немного поясню принцип, используемый при группировке. По каждому из запросов вашего семядра в поисковую систему будет отправлен запрос и будут сняты данные по Топ 10 (Урлы страниц попавших в Топ — веб-документы). Потом система анализирует, какие страницы сумели попасть сразу в несколько Топов (по разным запросам). Что это означает? А означает то, что данные запросы вполне можно объединить (сгруппировать) для продвижения на одной странице (в одном веб-документе), и это не домыслы, а факты, подтвержденные самой поисковой системой.

Название такой группы Топвизор задаст в соответствии с самым частотным запросом в этой группе. Если по каким-то запросам не будет найдено повторений посадочных страниц (веб-документов), то они будут помещены в отдельную группу «Запросы без связей». В этом случае нужно будет подумать либо про расширение семядра в сторону использования созвучных с ними запросов, либо отводить под продвижение каждого из них отдельную страницу на вашем сайте (исходя из их частотности и целесообразности сего действа).

В TopVizor кластеризацию можно делать и для собранного в нем же семядра (как в нашем примере), и для импортированного списка ключевых слов (если вам уже кто-то подобрал запросы и их осталось только распределить по страницам). Стоимость перегруппировки составляет 0,01 руб. за запрос.

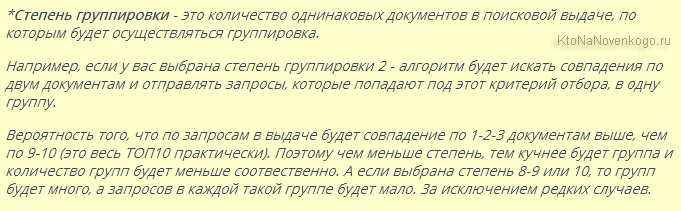

В окне «Кластеризация» также имеется возможность указать степень группировки. Что это такое? Фактически это число документов в выдачи, по наличию которых в Топах будет осуществляться группировка запросов. Например, если выбрать единичку, то достаточно будет найти в Топ 10 один документ, который по данным запросам туда попал, и на основе этих данных можно составлять группу.

Но один факт это ведь еще не тенденция, поэтому лучше, чтобы таких совпадений было бы хотя бы штуки три. С ходу наверное не совсем все ясно, но может быть гайд от разработчиков будет вам более понятен, чем мои пространные объяснения:

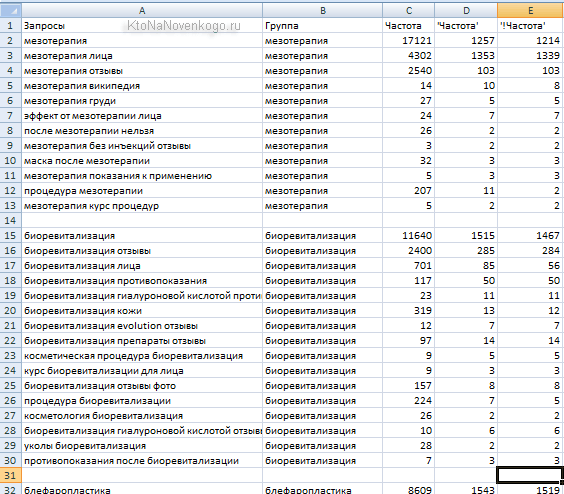

Сам процесс кластеризации займет какое-то время (зависит от числа запросов в вашем семантическом ядре, ибо 1000 запросов обрабатывается примерно две-три минуты). По окончании вы увидите много блоков с вновь созданными группами, которые уже можно смело начинать переносить на отдельные страницы сайта (одна группа — одна страница) в виде написанных и оптимизированных под них текстов.

Само собой разумеется, что съем позиций по этим вновь сгруппированным запросам пока вестись не будет (слева от названия группы будет показана красная точка). Для запуска же съема позиций по ним (например, после публикации страницы вашего сайта под них оптимизированных) достаточно будет кликнуть по этой самой красной точке в нужной группе, чтобы она стала зеленой.

Ну и, кончено же, будет уместно посмотреть на результат, который может получиться после автогруппировки запросов в Топвизоре — пример (файлик в формате CSV).

Как бы очень даже удобно. Запросы разбиты на группы под отдельные страницы, а также отсортированы по частоте. Остается только написать под них тексты, либо дооптимизировать уже существующие.

Проверка частотности запросов и цены клика для них в Яндекс Директе

Вот, смотрите. Мы собрали запросы из левой и правой колонки Вордстата, спарсили поисковые подсказки и получили целый набор групп ключевиков. Теперь настала пора избавиться от пустышек и бесперспективных. Для этого нужно будет пробить частотность в Yandex Wordstat по всем этим ключевым фразам.

Этой цели служит пятая иконка на панели инструментов вкладки «Ядро». В открывшемся окне вы вольны будете выбрать, какую именно частотность хотите определить (из трех возможных, описанных чуть ниже), в каком регионе и хотите ли при этом сэкономить, поставив галочку, запрещающую обновление уже имеющихся данных (которые снимали вы или другие пользователи Топвизора).

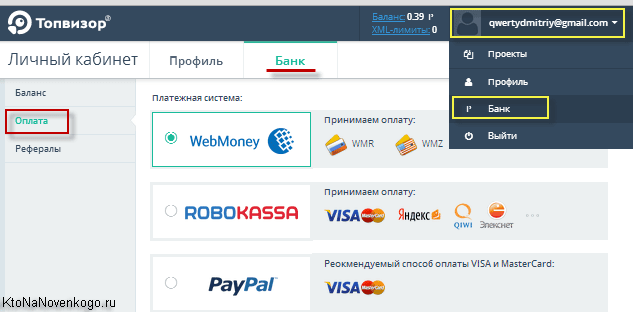

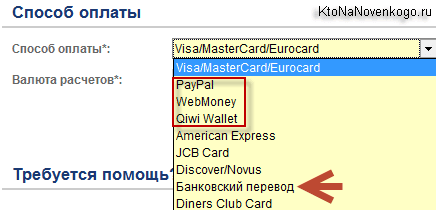

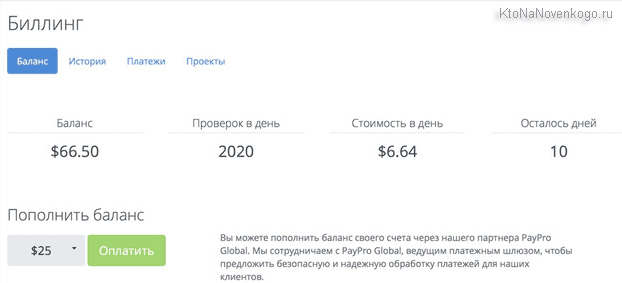

Но в самый интересный момент у меня кончились те десять рублей, что выдаются при регистрации. Поэтому пришлось выбрать из выпадающего меню моего логина пункт «Банк» и перейти в открывшемся окне на вкладку «Оплата».

Собственно, про доступные способы оплаты я уже упоминал, ну, а я как обычно воспользовался своим кошельком в Вебманях.

После совершения платежа я все-таки запустил съем частности по всем собранным запросам, который сопровождался волнообразной полосатостью кнопки:

Через несколько секунд появилась оранжевая табличка, призывающая обновить страницу и ознакомиться с результатами.

Если вы вдруг по-прежнему не у всех запросов увидите значение частоты их использования, то не спешите ругать Топвизор и требовать вернуть ваши деньги.

Дело в том, что снимать можно три значения частотности (общую, фразовую и точную). Я, например, снимал фразовую, а по умолчанию в верхнем выпадающем списке выбрана общая. Поэтому, просто выбрав фразовую частотность, я получил показанную на скриншоте картину маслом.

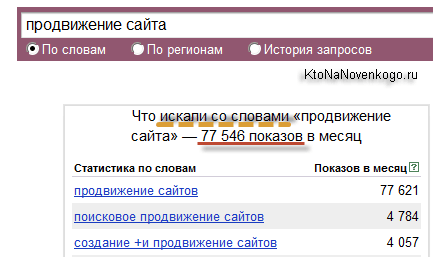

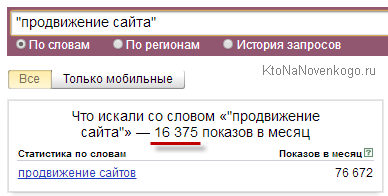

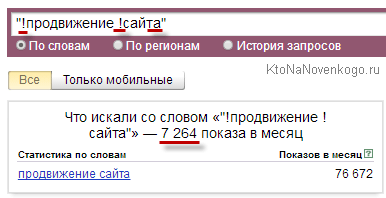

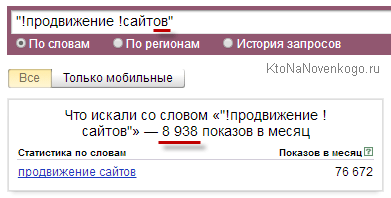

Да, забыл сказать пару слов про этим самые частотности. Ничего сложно в этом нет и корни сей градации уходят в описанные мною операторы поиска Яндекса, а именно кавычки и восклицательный знак проставленный перед словом. Эти же операторы и с тем же назначением можно использовать и в окне Вордстата при вводе запроса (заключать его в кавычки или ставить ! перед каждым словом).

- Обычная — вводите запрос как есть и получаете все словосочетания, которые включают в себя данную фразу, хотя реальная частотность запроса этого ключа может быть и нулевой.

- Фразовая — запрос заключается в кавычки и в результате будут посчитаны запросы именно этих слов, но во всех возможных морфологических формах (падежах, числах).

Лично я предпочитаю именно этот вариант, ибо оптимизировать статью под строгую морфологическую форму я не в силах, хотя иногда стоит понять в каком виде лучше всего ключевик употребить в тайтле.

- Точная — кроме кавычек добавляем еще и восклицательный знак перед каждым словом. В результате будет посчитана частота ввода этого словосочетания (именно в этой морфологической форме) пользователями Яндекса в течении месяца.

Откуда взялась такая разница в цифрах? Очевидно, что имеет место быть запрос(ы) с теми же самым ключевыми словами, но в другой словоформе, который отъедает оставшиеся цифирьки. Для нашего примера нетрудно догадаться, что это будет множественное число:

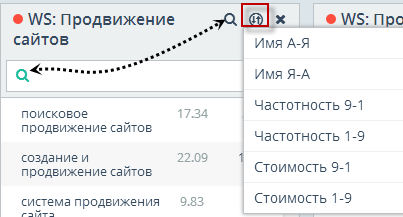

Собранные в каждой группе запросы можно сортировать по алфавиту, по частоте, а также и по стоимости клика в Яндекс Директе. Если ключевых слов в группе много, то можно воспользоваться внутренним поиском.

Теперь вам только останется пробежаться по всем группам запросов и поудалять те, что имеют близкую к нулю частотность и у которых зашкаливает цена за клик. Например, запрос «продвижение сайта» имеет цену за Спецразмещение в 45 рублей за клик (пожалуй, что именно этот вариант отображения цены лучше всего характеризует перспективность продвижения), что слишком дорого и говорит о чудовищной конкуренции по этой ключевой фразе.

Я бы никогда не стал оптимизироваться под нее, хотя бывают случаи, когда продвижение по СЧ приводит сайт в Топ по ВЧ. Собственно, у меня в Топ 10 сейчас блог уже не попадает по фразе «продвижение сайта» (хотя он и бывал на девятой позиции), но даже текущее место на второй странице объясняется лишь действием алгоритма Спектр, а не моими финансовыми вливаниями.

Когда поудаляете все лишнее, то можно все ключевые фразы перетащить в одну группу, а лишние удалить. На этом добавление запросов и сборка ядра подошла к концу, а мы продолжаем изучать возможности Топвизора уже по проверке и отображения позиций сайта в выдачах Яндекса, Гугла или Майл.ру.

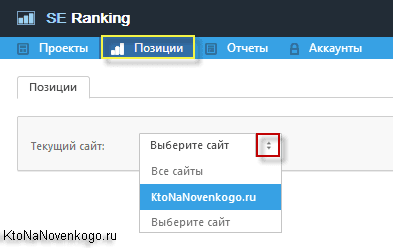

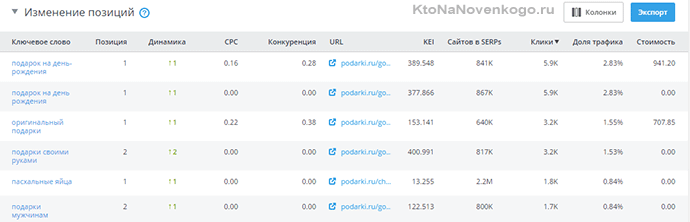

Проверка позиций сайта в TopVizor

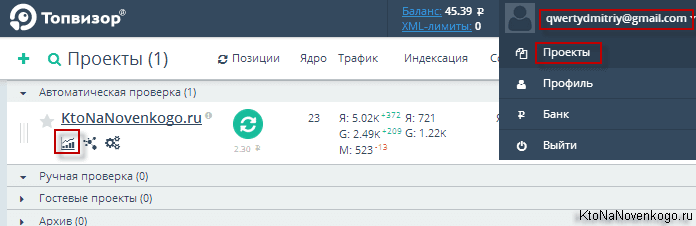

Переходим на вкладку «Позиции» из верхнего меню. Сразу же оговорюсь, что попасть туда же можно будет и из контекстного меню вашего логина, выбрав пункт «Проекты» и кликнув на открывшейся странице по показанной на скриншоте иконке.

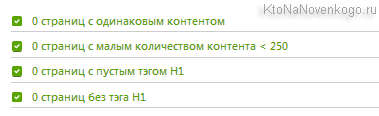

Обратите внимание, что я разрешил Топвизору взять данные из моих аккаунтов в Метрике и Вебмастере, поэтому могу наглядно наблюдать динамику по следующим параметрам на этой странице:

- Большая зелена кнопка служит для ручного запуска съема, а внизу отображается стоимость такой операции.

- Число посетителей за последние сутки, которые пришли на мой сайт с поисковых систем Яндекс, Гугл и Майл.ру (для каждой в отдельности)

- Число страниц в индексе Яндекса и Google

- Количество обратных ссылок по версии Вебмастера

- Тиц и Пр

- Наличие в каталогах Яндекса, Дмоз или Майл.ру — кликнув по зеленой галочке можно попасть на страницу данного каталога с описанием вашего сайта

Но это мы отвлеклись, а теперь давайте, наконец, зайдем на вкладку «Позиции» и посмотрим что там к чему.

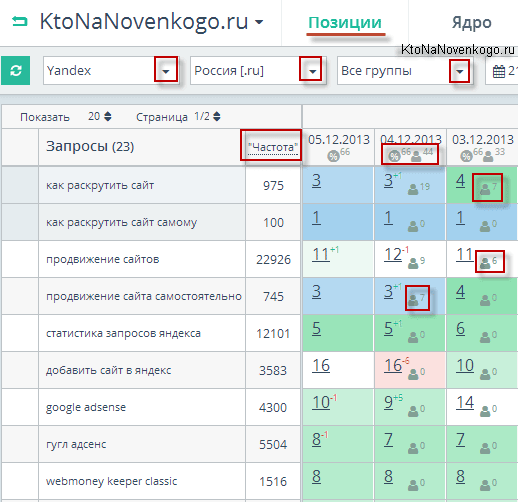

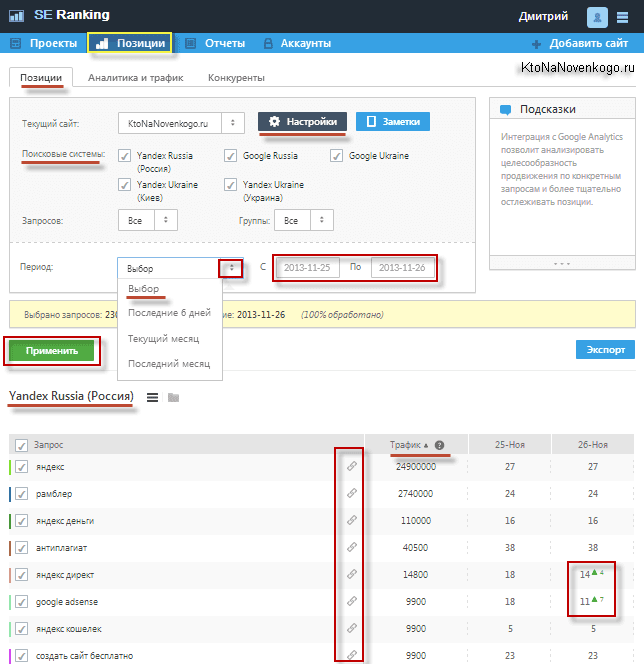

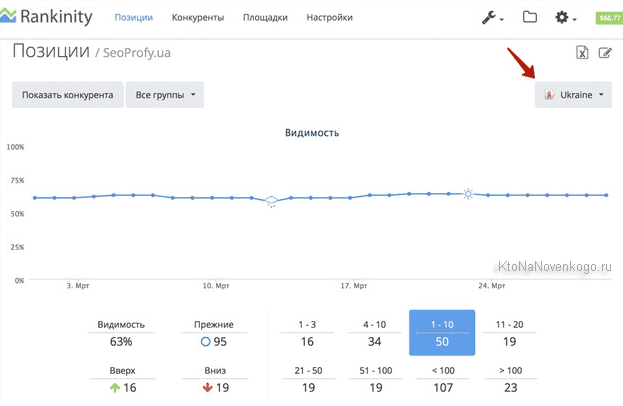

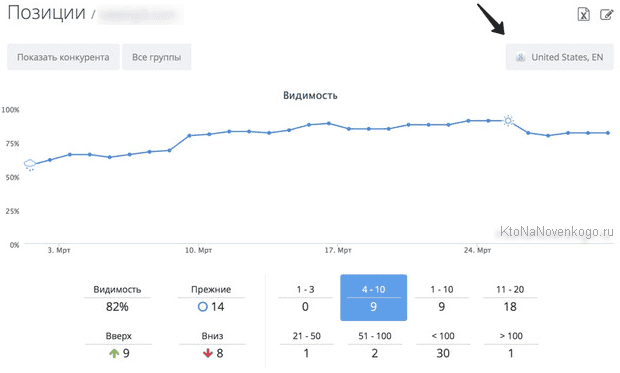

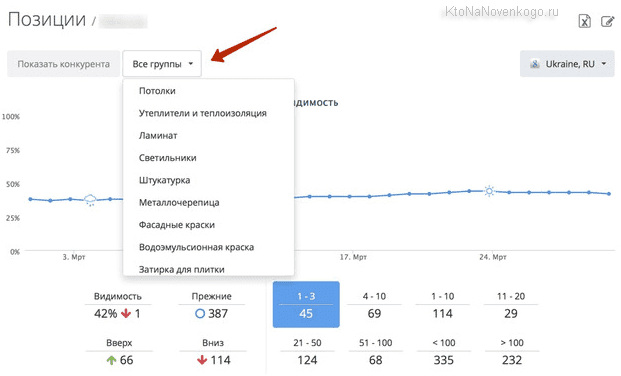

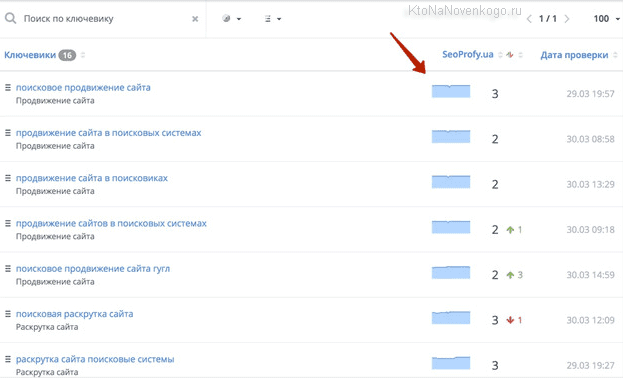

Из верхнего меню с помощью выпадающих списков выбираете поисковую систему, регион, а так же группу запросов, для которой хотите посмотреть динамику изменения позиций за последнее время.

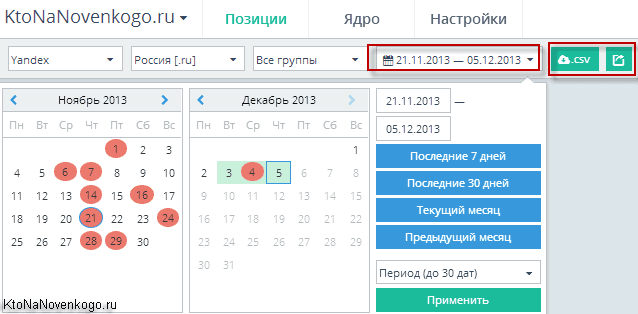

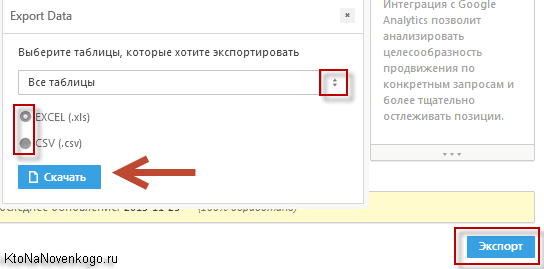

Чуть правее расположено окно выбора отчетного периода и кнопки для выгрузки данных в формате CSV и Html (последняя позволяет как отправить данные по почте, так и скачать на компьютер).

Если внимательно взглянуть на таблицу со снятыми позициями, то можно заметить, что рядом с некоторыми позициями стоят циферки (отличные от нуля) взятые из Метрики, которые говорят о том, сколько человек в этот день пришли к вам на сайт, введя данные слова в той поисковой машине, для которой вы просматриваете позиции.

Имеется отдельная колонка с частотностью данных запросов. Но какая именно из трех возможных частот отображается и как их поменять? Довольно просто — кликаете по слову «частота» и оно будет отображаться с кавычками, с восклицательным знаком или в естественном виде. Очень удобно, на мой взгляд.

Вверху каждой колонки проставлена дата проверки позиций. Если по ней кликнуть, то произойдет сортировка данных в таблице по значениям цифирек в колонке. Под датой вы сможете увидеть процентное соотношение запросов, которые попали в Топ 10 и суммарный трафик, которые они привели на ваш ресурс.

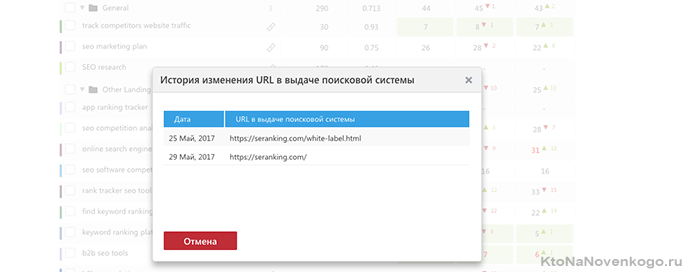

Что примечательно, если кликнуть по любой позиции в этой таблице, то вы перейдете на ту страницу своего сайта, которая является для этого запроса целевой (приземляющей) по версии того поисковика, который вы выбрали из верхнего правого списка. Урлы этих страниц также попадают в CSV файл при выгрузке.

Сами клетки с позициями имеют цветовую дифференциацию по следующему принципу:

- Розовая подсветка говорит о том, что все плохо и ваш сайт по данному запросу провалился по крайней мере на одну страницу в глубь серпа (имеются в виду настойки выдачи по умолчанию, когда на странице отображаются 10 сайтов с ответами).

- Желтый фон тоже не сулит ничего хорошего, ибо говорит, что вашего сайта не видать в обозреваемом Топвизором пространстве (первые 100 позиций). В Google у меня как раз много подобных цветовых решений по данным ключевым словам:

- Зеленый цвет говорит о том, что сайт находит в Топ 10, но еще не попал в Топ3.

- Голубоватый — желанный Топ3 достигнут

- Салатовый цвет обнадеживает хотя бы тем, что запрос стал по крайней мере на одну страницу ближе к Топу.

Кому может быть полезен этот онлайн сервис?

Ну, вроде бы все, чем хотел с вами поделиться. Получилось довольно объемно, но и возможностей у данного онлайн сервиса оказалось больше, нежели у традиционного инструмента по снятию позиций.

Получается, что сервис будет удобен не только тем, кто проверяет позиции, но и тем, кто работает с семантическим ядром, а это могут быть, например, люди, которые пользуются системами контекстной рекламы или другие пользователи, которым нужно подобрать ключевые слова.

Что примечательно, за время тестирования не было ни одного лага связанного с медленной работой этого онлайн сервиса. Создавалось впечатление, что работаешь с десктопной программой. А каким вам, уважаемые читатели, показался сервис Топвизор?

Идея реализовать в Топвизоре полноценную цепочку инструментов для пошаговой сборки семантического ядра мне очень понравилась. Можно будет включится в это дело как с самого начала, так и на любом шаге, импортировав уже имеющиеся у вас запросы и добрав все недостающие запросы до получения полноценно семядра.

Ну, а модуль кластеризации позволил все этого дело оформить в завершенную логическую цепочку, когда на выходе уже получаем список ключевых слов с постраничной привязкой. Останется только передать его оптимизаторам, чтобы те составили задания для копирайтеров. Либо сделать это все самому.

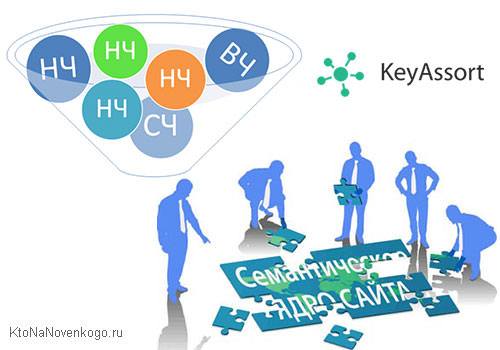

KeyAssort — как составить семантическое ядро и создать структуру сайта

Хочу сделать очередной заход на тему «сбора семядра». Сначала будет немного лирики, как полагается, а потом много практики, может быть и несколько неуклюжей в моем исполнении. Итак, лирика. Ходить с завязанными глазами в поисках удачи мне надоело уже через год, после начала ведения этого блога. Да, были «удачные попадания» (интуитивное угадывание часто задаваемых поисковикам запросов) и был определенный трафик с поисковиков, но хотелось каждый раз бить в цель (по крайней мере, ее видеть).

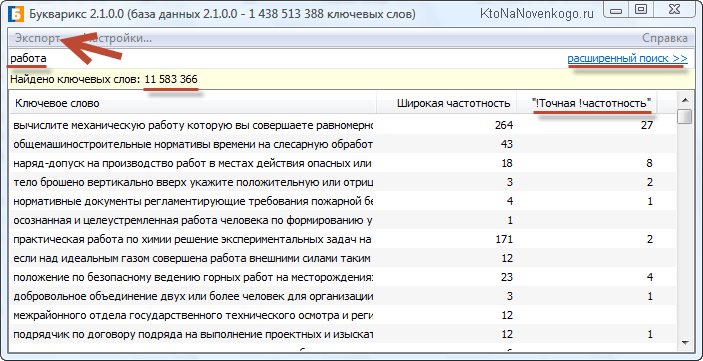

По сути ж ведь нет ничего зазорного в том, чтобы заранее понять, в какие чудесные слова облекают свои хотелки те, кому будут адресованы будущие публикации. Учтя это (собрав семантику под статью), мы повышаем шансы на успех (покорение Топа по этим фразам — см. словарь SEO-балбеса). По этому поводу была написана статья про работу с Вордстатом и этап сбора семядра.

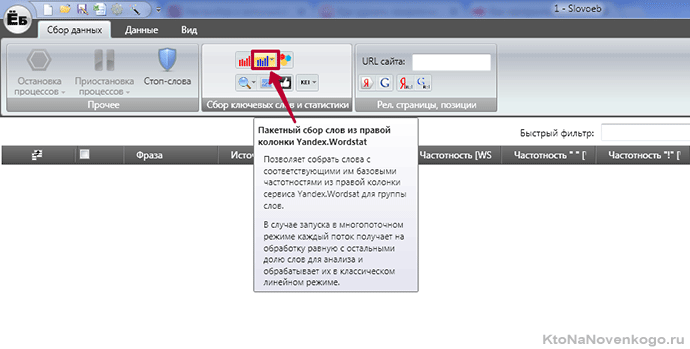

Потом захотелось большего — автоматизации процесса сбора запросов и отсева «пустышек». По этой причине появился опыт работы с Кейколлектором (и его неблагозвучным младшим братом) и очередная статья на тему автоматизации процесса подбора поисковых запросов. Все было здорово и даже просто замечательно, пока я не понял, что есть один таки очень важный момент, оставшийся по сути за кадром — раскидывание запросов по статьям.

Писать отдельную статью под отдельный запрос оправдано либо в высококонкурентных тематиках, либо в сильно доходных. Для инфосайтов же — это полный бред, а посему приходится запросы объединять на одной странице. Как? Интуитивно, т.е. опять же вслепую. А ведь далеко не все запросы уживаются на одной странице и имеют хотя бы гипотетический шанс выйти в Топ.

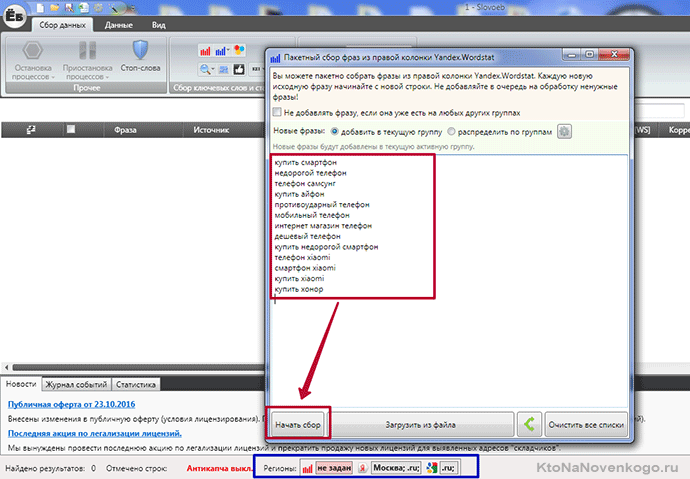

Собственно, сегодня как раз и пойдет речь об автоматической кластеризации семантического ядра посредством KeyAssort (разбивке запросов по страницам, а для новых сайтов еще и построение на их основе структуры, т.е. разделов, категорий). Ну, и сам процесс сбора запросов мы еще раз пройдем на всякий пожарный (в том числе и с новыми инструментами).

Какой из этапов сбора семантического ядра самый важный?

Сам по себе сбор запросов (основы семантического ядра) для будущего или уже существующего сайта является процессом довольно таки интересным (кому как, конечно же) и реализован может быть несколькими способами, результаты которых можно будет потом объединить в один большой список (почистив дубли, удалив пустышки по стоп словам).

Например, можно вручную начать терзать Вордстат, а в добавок к этому подключить Кейколлектор (или его неблагозвучную бесплатную версию). Однако, это все здорово, когда вы с тематикой более-менее знакомы и знаете ключи, на которые можно опереться (собирая их производные и схожие запросы из правой колонки Вордстата).

В конце концов, есть и бесплатный Букварис, который позволяет очень быстро стартануть в сборе запросов. Также можно заказать частным образом выгрузку из монстрообразной базы Ahrefs и получить опять таки ключи ваших конкурентов. Вообще, стоит рассматривать все, что может принести хотя бы толику полезных для будущего продвижения запросов, которые потом не так уж сложно будет почистить и объединить в один большой (зачастую даже огромный список).

Все это мы (в общих чертах, конечно же) рассмотрим чуть ниже, но в конце всегда встает главный вопрос — что делать дальше. На самом деле, страшно бывает даже просто подступиться к тому, что мы получили в результате (пограбив десяток-другой конкурентов и поскребя по сусекам Кейколлектором). Голова может лопнуть от попытки разбить все эти запросы (ключевые слова) по отдельным страницах будущего или уже существующего сайта.

Какие запросы будут удачно уживаться на одной странице, а какие даже не стоит пытаться объединять? Реально сложный вопрос, который я ранее решал чисто интуитивно, ибо анализировать выдачу Яндекса (или Гугла) на предмет «а как там у конкурентов» вручную убого, а варианты автоматизации под руку не попадались. Ну, до поры до времени. Все ж таки подобный инструмент «всплыл» и о нем сегодня пойдет речь в заключительной части статьи.

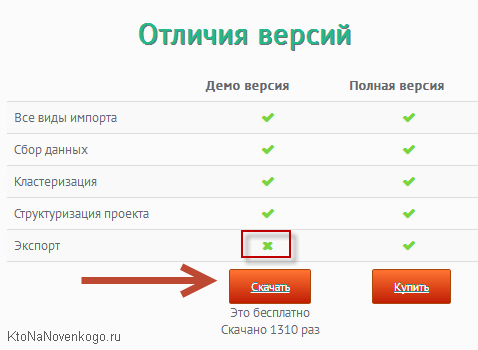

Это не онлайн-сервис, а программное решение, дистрибутив которого можно скачать на главной странице официального сайта (демо-версию).

Посему никаких ограничений на количество обрабатываемых запросов нет — сколько надо, столько и обрабатывайте (есть, однако, нюансы в сборе данных). Платная версия стоит менее двух тысяч, что для решаемых задач, можно сказать, даром (имхо).

Но про техническую сторону KeyAssort мы чуть ниже поговорим, а тут хотелось бы сказать про сам принцип, который позволяет разбить список ключевых слов (практически любой длины) на кластеры, т.е. набор ключевых слов, которые с успехом можно использовать на одной странице сайта (оптимизировать под них текст, заголовки и ссылочную массу — применить магию SEO).

Откуда вообще можно черпать информацию? Кто подскажет, что «выгорит», а что достоверно не сработает? Очевидно, что лучшим советчиком будет сама поисковая система (в нашем случае Яндекс, как кладезь коммерческих запросов). Достаточно посмотреть на большом объеме данных выдачу (допустим, проаналазировать ТОП 10) по всем этим запросам (из собранного списка будущего семядра) и понять, что удалось вашим конкурентам успешно объединить на одной странице. Если эта тенденция будет несколько раз повторяться, то можно говорить о закономерности, а на основе нее уже можно бить ключи на кластеры.

KeyAssort позволяет в настройках задавать «строгость», с которой будут формироваться кластеры (отбирать ключи, которые можно использовать на одной странице). Например, для коммерции имеет смысл ужесточать требования отбора, ибо важно получить гарантированный результат, пусть и за счет чуть больших затрат на написание текстов под большее число кластеров. Для информационных сайтов можно наоборот сделать некоторые послабления, чтобы меньшими усилиями получить потенциально больший трафик (с несколько большим риском «невыгорания»). Как это сделать опять же поговорим.

А что делать, если у вас уже есть сайт с кучей статей, но вы хотите расширить существующее семядро и оптимизировать уже имеющиеся статьи под большее число ключей, чтобы за минимум усилий (чуток сместить акцент ключей) получить поболе трафика? Эта программка и на этот вопрос дает ответ — можно те запросы, под которые уже оптимизированы существующие страницы, сделать маркерными, и вокруг них KeyAssort соберет кластер с дополнительными запросами, которые вполне успешно продвигают (на одной странице) ваши конкуренты по выдаче. Интересненько так получается...

Как собрать пул запросов по нужной вам тематике?

Любое семантическое ядро начинается, по сути, со сбора огромного количества запросов, большая часть из которых будет отброшена. Но главное, чтобы на первичном этапе в него попали те самые «жемчужины», под которые потом и будут создаваться и продвигаться отдельные страницы вашего будущего или уже существующего сайта. На данном этапе, наверное, самым важным является набрать как можно больше более-менее подходящих запросов и ничего не упустить, а пустышки потом легко отсеяться.

Встает справедливый вопрос, а какие инструменты для этого использовать? Есть один однозначный и очень правильный ответ — разные. Чем больше, тем лучше. Однако, эти самые методики сбора семантического ядра, наверное, стоит перечислить и дать общие оценки и рекомендации по их использованию.

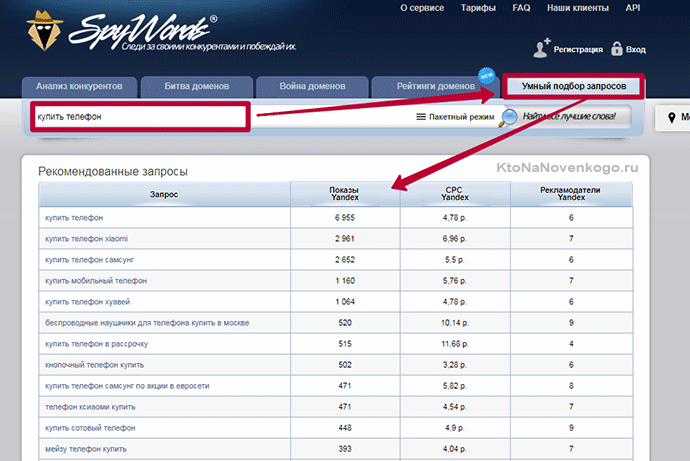

- Яндекс Вордстат и его аналоги у других поисковых систем — изначально эти инструменты предназначались для тех, кто размещает контекстную рекламу, чтобы они могли понимать, насколько популярны те или иные фразы у пользователей поисковиков. Ну, понятно, что Сеошники этими инструментами пользуются тоже и весьма успешно. Могу порекомендовать пробежаться глазами по статье про работу со статистикой поисковых запросов, а также упомянутой в самом начале этой публикации статье про семядро и Я.Вордстат (полезно будет начинающим).

Из недостатков Водстата можно отметить:

- Чудовищно много ручной работы (однозначно требуется автоматизация и она будет рассмотрена чуть ниже), как по пробивке фраз основанных на ключе, так и по пробивке ассоциативных запросов из правой колонки.

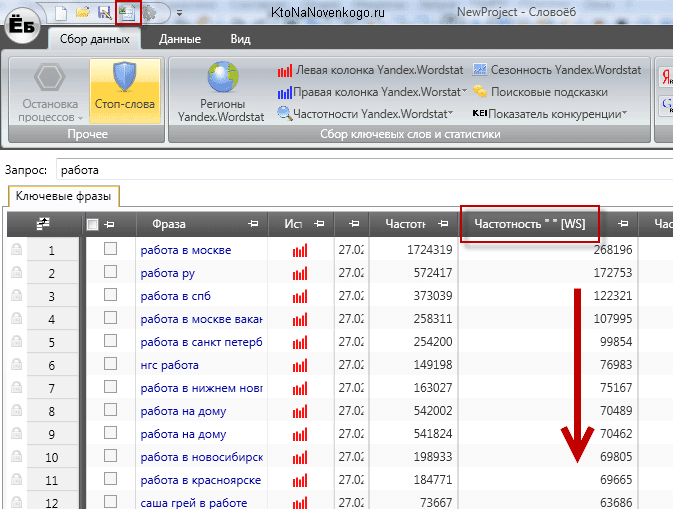

- Ограничение выдачи Вордстата (2000 запросов и не строчкой больше) может стать проблемой, ибо для некоторых фраз (например, «работа») это крайне мало и мы упускаем из вида низкочастотные, а иногда даже и среднечастотные запросы, способные приносить неплохой трафик и доход (их ведь многие упускают). Приходится «сильно напрягать голову», либо использовать альтернативные методы (например, базы ключевых слов, одну из которых мы рассмотрим ниже — при этом она бесплатная!).

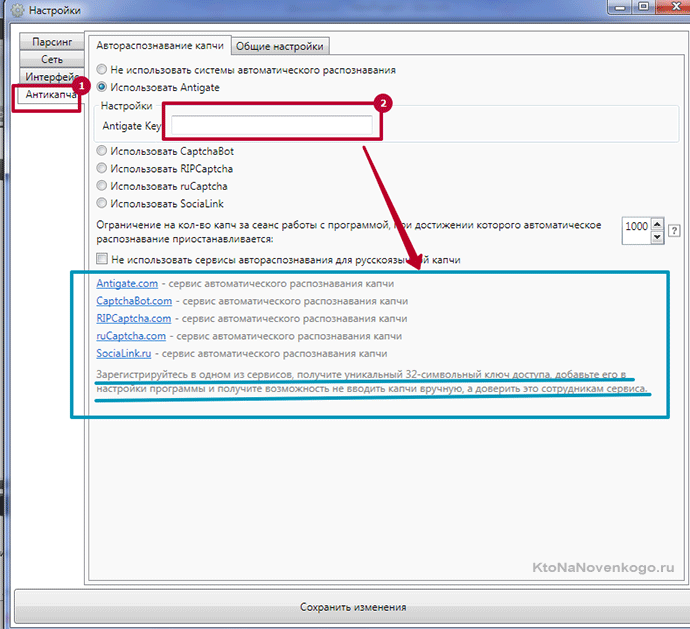

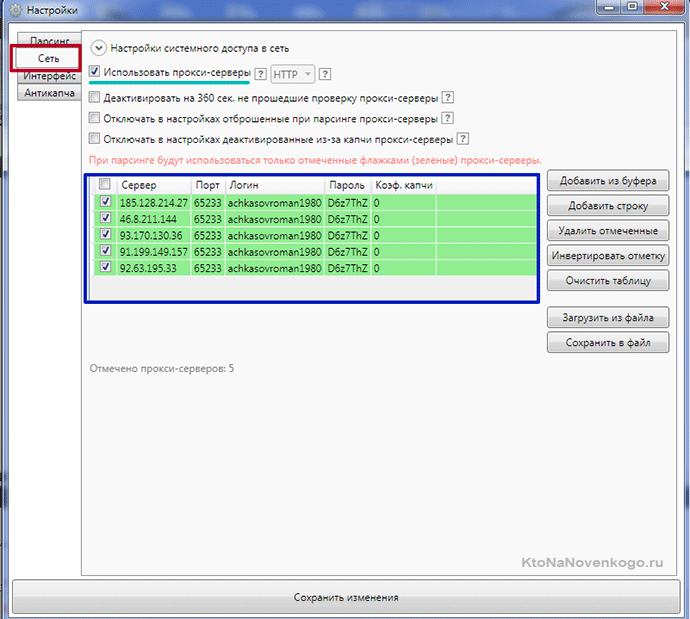

- КейКоллектор — несколько лет назад появление этой программы было просто «спасением» для многих тружеников сети (да и сейчас представить без КК работу над семядром довольно трудно). Лирика. Я купил КК еще два или три года назад, но пользовался им от силы несколько месяцев, ибо программа привязана к железу (начинке компа), а она у меня по нескольку раз в год меняется. В общем, имея лицензию на КК пользуюсь SE — так то вот, до чего лень доводит.

Подробности можете почитать в статье «Автоматизация сбора семядра в Slovoeb». Обе программы помогут вам собрать запросы и из правой, и из левой колонки Вордстата, а также поисковые подсказки по нужным вам ключевым фразам. Подсказки — это то, что выпадает из поисковой строки, когда вы начинаете набирать запрос. Пользователи часто не закончив набор просто выбирают наиболее подходящий из этого списка вариант. Сеошники это дело просекли и используют такие запросы в оптимизации и даже пытаются их накручивать.

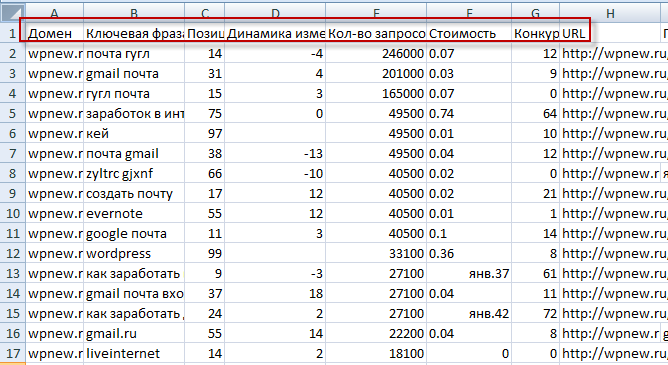

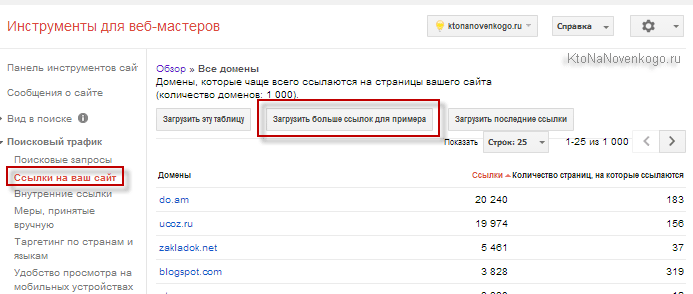

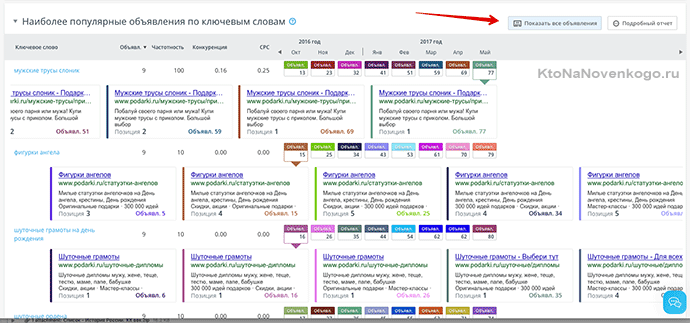

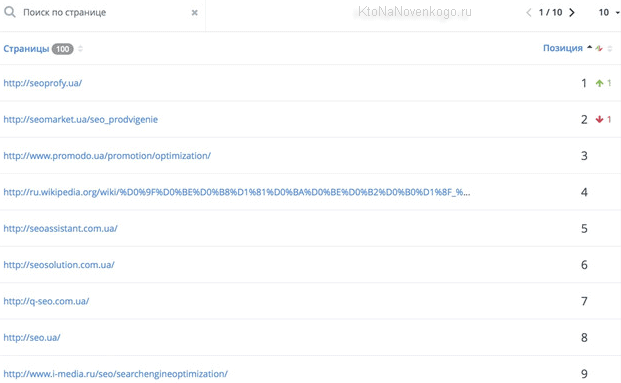

КК и SE позволяют сразу набрать очень большой пул запросов (правда, может потребоваться много времени, либо покупка XML лимитов, но об этом чуть ниже) и легко отсеять пустышки, например, проверкой частотности фраз взятых в кавычки (учите матчасть, если не поняли о чем речь — ссылки в начале публикации) или задав список стоп-слов (особо актуально для коммерции). После чего весь пул запросов можно легко экспортировать в Эксель для дальнейшей работы или для загрузки в KeyAssort (кластеризатор), о котором речь пойдет ниже. - СерпСтат (и другие подобные сервисы) — позволяет введя Урл своего сайта получить список ваших конкурентов по выдаче Яндекса и Гугла. А по каждому из этих конкурентов можно будет получить полный список ключевых слов, по которым им удалось пробиться и достичь определенных высот (получить трафик с поисковиков). Сводная таблица будет содержать частотность фразы, место сайта по ней в Топе и кучу другой разной полезной и не очень информации.

Не так давно я пользовал почти самый дорогой тарифный план Серпстата (но только один месяц) и успел за это время насохранять в Экселе чуть ли не гигабайт разных полезняшек. Собрал не только ключи конкурентов, но и просто пулы запросов по интересовавшим меня ключевым фразам, а также собрал семядра самых удачных страниц своих конкурентов, что, мне кажется, тоже очень важно. Одно плохо — теперь никак время не найду, чтобы вплотную заняться обработкой всей это бесценной информации. Но возможно, что KeyAssort все-таки снимет оцепенение перед чудовищной махиной данных, которые нужно обработать.

- Букварикс — бесплатная база ключевых слов в своей собственной программной оболочке. Подбор ключевиков занимает доли секунды (выгрузка в Эксель минуты). Сколько там миллионов слов не помню, но отзывы о ней (в том числе и мой) просто отличные, и главное все это богатство бесплатно! Правда, дистрибутив программы весить 28 Гигов, а в распокованном виде база занимает на жестком диске более 100 Гбайт, но это все мелочи по сравнению с простотой и скоростью сбора пула запросов.

Но не только скорость сбора семядра является основным плюсом по сравнению с Вордстатом и КейКоллектором. Главное, что тут нет ограничений на 2000 строк для каждого запроса, а значит никакие НЧ и сверх НЧ от нас не ускользнут. Конечно же, частотность можно будет еще раз уточнить через тот же КК и по стоп-словам в нем отсев провести, но основную задачу Букварикс выполняет замечательно. Правда, сортировка по столбцам у него не работает, но сохранив пул запросов в Эксель там можно будет сортировать как заблагороссудится.

Наверное, еще как минимум несколько «серьезных» инструментов собора пула запросов приведете вы сами в комментариях, а я их успешно позаимствую...

Как очистить собранные поисковые запросы от «пустышек» и «мусора»?

Полученный в результате описанных выше манипуляций список, скорее всего, будет весьма большим (если не огромным). Поэтому прежде чем загружать его в кластерезатор (у нас это будет KeyAssort) имеет смысл его слегка почистить. Для этого пул запросов, например, можно выгрузить к кейколлектор и убрать:

- Запросы со слишком низкой частотностью (лично я пробиваю частотность в кавычках, но без восклицательных знаков). Какой порог выбирать решать вам, и во многом это зависит от тематики, конкурентности и типа ресурса, под который собирается семядро.

- Для коммерческих запросов имеется смысл использовать список стоп-слов (типа, «бесплатно», «скачать», «реферат», а также, например, названия городов, года и т.п.), чтобы заранее убрать из семядра то, что заведомо не приведет на сайт целевых покупателей (отсеять халявшиков, ищущих информацию, а не товар, ну, и жителей других регионов, например).

- Иногда имеет смысл руководствоваться при отсеве показателем конкуренции по данному запросу в выдаче. Например, по запросу «пластиковые окна» или «кондиционеры» можно даже не рыпаться — провал обеспечен заранее и со стопроцентной гарантией.

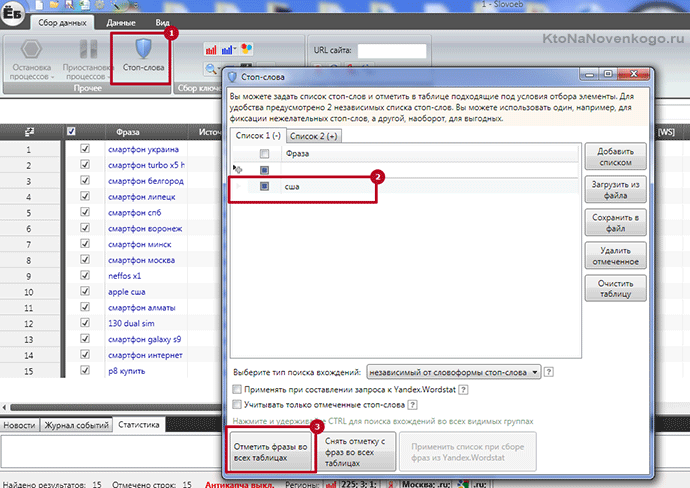

Скажите, что это слишком просто на словах, но сложно на деле. А вот и нет. Почему? А потому что один уважаемый мною человек (Михаил Шакин) не пожалел времени и записал видео с подробным описанием способов очистки поисковых запросов в Key Collector:

Спасибо ему за это, ибо данные вопрос гораздо проще и понятнее показать, чем описать в статье. В общем справитесь, ибо я в вас верю...

Настройка кластеризатора семядра KeyAssort под ваш сайт

Собственно, начинается самое интересное. Теперь весь этот огромный список ключей нужно будет как-то разбить (раскидать) на отдельных страницах вашего будущего или уже существующего сайта (который вы хотите существенно улучшить в плане приносимого с поисковых систем трафика). Не буду повторяться и говорить о принципах и сложности данного процесса, ибо зачем тогда я первую часть этой стать писал.

Итак, наш метод довольно прост. Идем на официальный сайт KeyAssort и скачиваем демо-версию, чтобы попробовать программу на зуб (отличие демо от полной версии — это невозможность выгрузить, то бишь экспортировать собранное семядро), а уже опосля можно будет и оплатить (1900 рубликов — мало, мало по современным реалиям). Если хотите сразу начать работу над ядром что называется «на чистовик», то лучше тогда выбрать полную версию с возможностью экспорта.

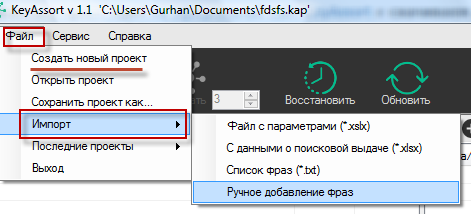

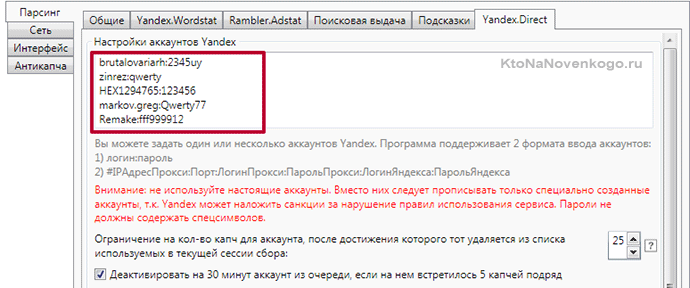

Программа КейАссорт сама собирать ключи не умеет (это, собственно, и не ее прерогатива), а посему их потребуется в нее загрузить. Сделать это можно четырьмя способами — вручную (наверное, имеется смысл прибегать к этому методу для добавления каких-то найденных уже опосля основного сбора ключей), а также три пакетных способа импорта ключей:

- в формате тхт — когда нужно импортировать просто список ключей (каждый на отдельной строке тхт файлика и с русской кодировкой определитесь заранее, чтобы кракозябры не получить).

- а также два варианта экселевского формата: с нужными вам в дальнейшем параметрами, либо с собранными сайтами из ТОП10 по каждому ключу. Последнее может ускорить процесс кластеризации, ибо программе KeyAssort не придется самой парсить выдачу для сбора эти данных. Однако, Урлы из ТОП10 должны быть свежими и точными (такой вариант списка можно получить, например, в Кейколлекторе).

Да, что я вам рассказываю — лучше один раз увидеть:

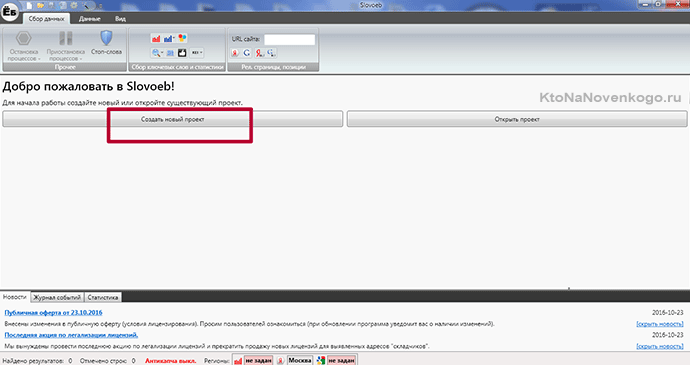

В любом случае, сначала не забудьте создать новый проект в том же самом меню «Файл», а уже потом только станет доступной функция импорта:

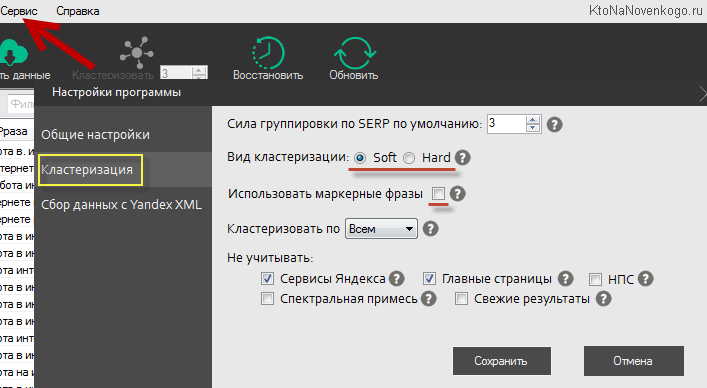

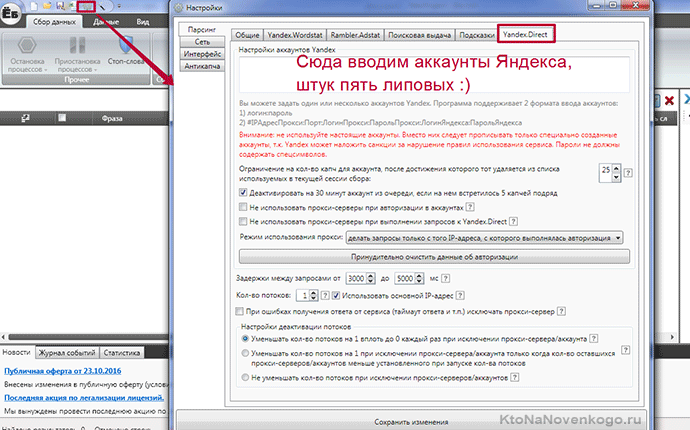

Давайте пробежимся по настройкам программы (благо их совсем немного), ибо для разных типов сайтов может оказаться оптимальным разный набор настроек. Открываете вкладку «Сервис» — «Настройки программы» и можно сразу переходить на вкладку «Кластеризация»:

Тут самое важное — это, пожалуй, выбор необходимого вам вида кластеризации. В программе могут использоваться два принципа, по которым запросы объединяются в группы (кластеры) — жесткий и мягкий.

- Hard — все запросы попавшие в одну группу (пригодные для продвижения на одной странице) должны быть объединены на одной странице у необходимого числа конкурентов из Топа (это число задается в строке «сила группировки»).

- Soft — все запросы попавшие в одну группу будут частично встречаться на одной странице у нужного числа конкурентов и Топа (это число тоже задается в строке «сила группировки»).

Есть хорошая картинка наглядно все это иллюстрирующая:

Если непонятно, то не берите в голову, ибо это просто объяснение принципа, а нам важна не теория, а практика, которая гласит, что:

- Hard кластеризацию лучше применять для коммерческих сайтов. Этот метод дает высокую точность, благодаря чему вероятность попадания в Топ объединенных на одной странице сайта запросов будет выше (при должном подходе к оптимизации текста и его продвижению), хотя самих запросов будет меньше в кластере, а значит самих кластеров больше (больше придется страниц создавать и продвигать).

- Soft кластеризацию имеет смысл использовать для информационных сайтов, ибо статьи будут получаться с высоким показателем полноты (будут способны дать ответ на ряд схожих по смыслу запросов пользователей), которая тоже учитывается в ранжировании. Да и самих страниц будет поменьше.

Еще одной важной, на мой взгляд, настройкой является галочка в поле «Использовать маркерные фразы». Зачем это может понадобиться? Давайте посмотрим.

Допустим, что у вас уже есть сайт, но страницы на нем были оптимизированы не под пул запросов, а под какой-то один, или же этот пул вы считаете недостаточно объемным. При этом вы всем сердцем хотите расширить семядро не только за счет добавления новых страниц, но и за счет совершенствования уже существующих (это все же проще в плане реализации). Значит нужно для каждой такой страниц добрать семядро «до полного».

Именно для этого и нужна эта настройка. После ее активации напротив каждой фразы в вашем списке запросов можно будет поставить галочку. Вам останется только отыскать те основные запросы, под которые вы уже оптимизировали существующие страницы своего сайта (по одному на страницу) и программа KeyAssort выстроит кластеры именно вокруг них. Собственно, все. Подробнее в этом видео:

Еще одна важная (для правильной работы программы) настройка живет на вкладке «Сбор данных с Яндекс XML». Что такое Яндекс XML и что такое лимиты вы можете прочитать в приведенной статье. Если вкратце, то Сеошники постоянно парсят выдачу Яндекса и выдачу Вордстата, создавая чрезмерную нагрузку на его мощности. Для защиты была внедрена капча, а также разработан спецдоступ по XML, где уже не будет вылезать капча и не будет происходить искажение данных по проверяемым ключам. Правда, число таких проверок в сутки будет строго ограничено.

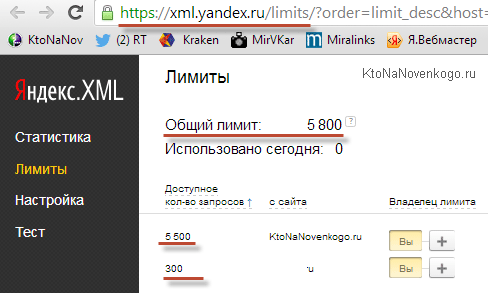

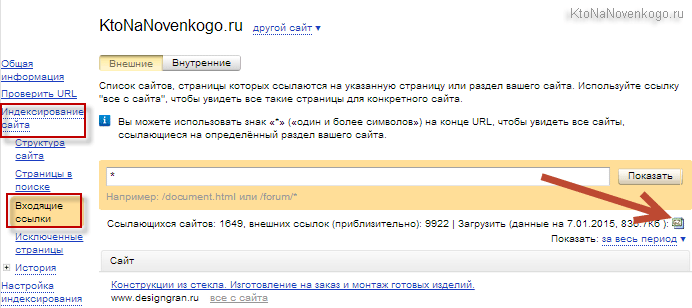

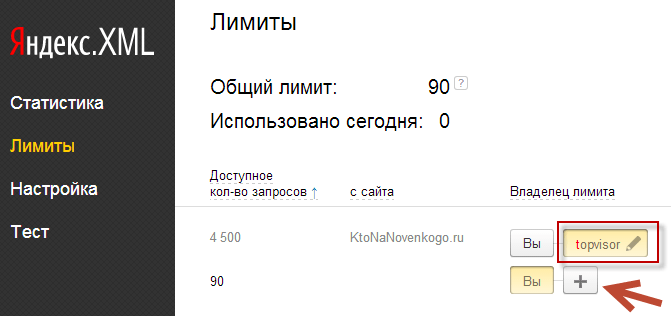

От чего зависит число выделенных лимитов? От того, как Яндекс оценит ваши сайты добавленные в панель Вебмастера. Посмотреть лимиты можно перейдя по этой ссылке (находясь в том же браузере, где вы авторизованы в Я.Вебмастере). Например, у меня это выглядит так:

Там еще есть снизу график распределения лимитов по времени суток, что тоже важно. Если запросов нужно пробить много, а лимитов мало, то не проблема. Их можно докупить. Не у Яндекса, конечно же, напрямую, а у тех, у кого эти лимиты есть, но они им не нужны.

Механизм Яндекс XML позволяет проводить передачу лимитов, а биржи, подвязавшиеся быть посредниками, помогают все это автоматизировать. Например, на XMLProxy можно прикупить лимитов всего лишь по 5 рублей за 1000 запросов, что, согласитесь, совсем уж не дорого.

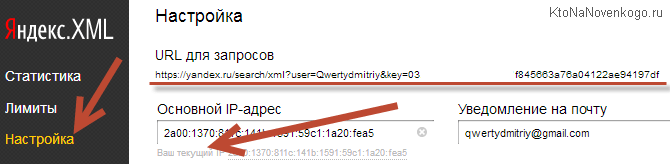

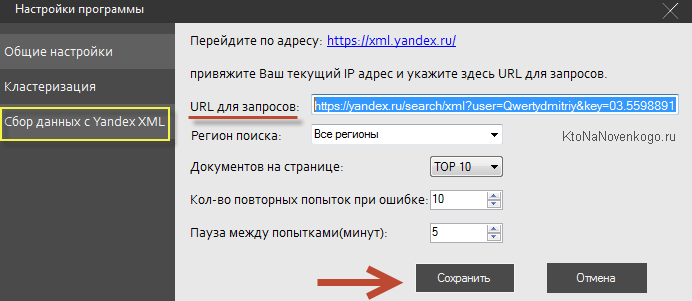

Но не суть важно, ибо купленные вами лимиты все равно ведь перетекут к вам на «счет», а вот чтобы их использовать в KeyAssort, нужно будет перейти на вкладку "Настройка« и скопировать длинную ссылку в поле „URL для запросов“ (не забудьте кликнуть по „Ваш текущий IP“ и нажать на кнопку „Сохранить“, чтобы привязать ключ к вашему компу):

После чего останется только вставить этот Урл в окно с настройками KeyAssort в поле „Урл для запросов“:

Собственно все, с настройками KeyAssort покончено — можно приступать к кластеризации семантического ядра.

Кластеризация ключевых фраз в KeyAssort

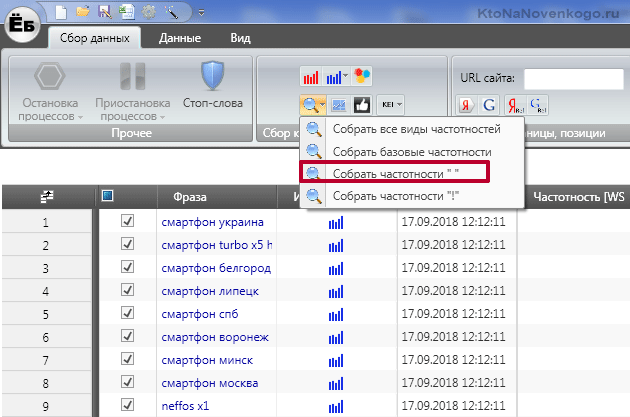

Итак, надеюсь, что вы все настроили (выбрали нужный тип кластеризации, подключили свои или покупные лимиты от Яндекс XML), разобрались со способами импорта списка с запросами, ну и успешно все это дело перенесли в КейАссорт. Что дальше? А дальше уж точно самое интересное — запуск сбора данных (Урлов сайтов из Топ10 по каждому запросу) и последующая кластеризация всего списка на основе этих данных и сделанных вами настроек.

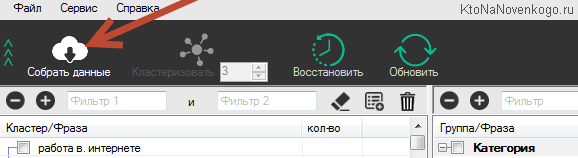

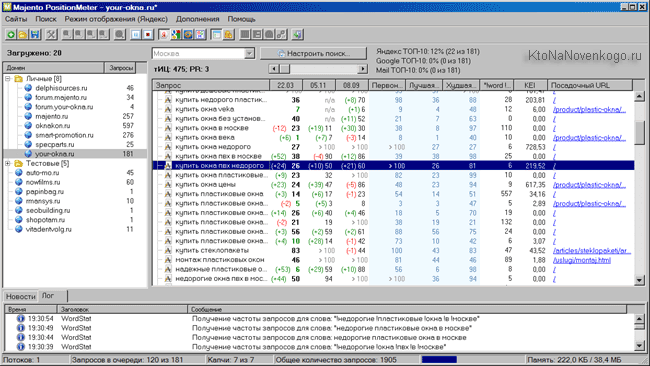

Итак, для начала жмем на кнопку „Собрать данные“ и ожидаем от нескольких минут до нескольких часов, пока программа прошерстит Топы по всем запросам из списка (чем их больше, тем дольше ждать):

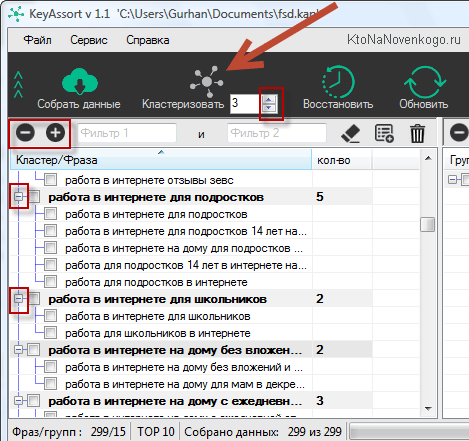

У меня на три сотни запросов (это маленькое ядро для серии статей про работу в интернете) ушло около минуты. После чего можно уже приступать непосредственно к кластеризации, становится доступна одноименная кнопка на панели инструментов KeyAssort. Процесс этот очень быстрый, и буквально через несколько секунд я получил целый набор калстеров (групп), оформленных в виде вложенных списков:

Подробнее об использовании интерфейса программы, а также про создание кластеров для уже существующих страниц сайта смотрите лучше в ролике, ибо так гораздо нагляднее:

Все, что хотели, то мы и получили, и заметьте — на полном автомате. Лепота.

Хотя, если вы создаете новый сайт, то кроме кластеризации очень важно бывает наметить будущую структуру сайта (определить разделы/категории и распределить по ним кластеры для будущих страниц). Как ни странно, но это вполне удобно делать именно в KeyAssort, но правда уже не в автоматическом режиме, а в ручном режиме. Как?

Проще опять же будет один раз увидеть — все верстается буквально на глазах простым перетаскиванием кластеров из левого окна программы в правое:

Если программу вы таки купили, то сможете экспортировать полученное семантическое ядро (а фактически структуру будущего сайта) в Эксель. Причем, на первой вкладке с запросами можно будет работать в виде единого списка, а на второй уже будет сохранена та структура, что вы настроили в KeyAssort. Весьма, весьма удобно.

Ну, как бы все. Готов обсудить и услышать ваше мнение по поводу сбора семядра для сайта.

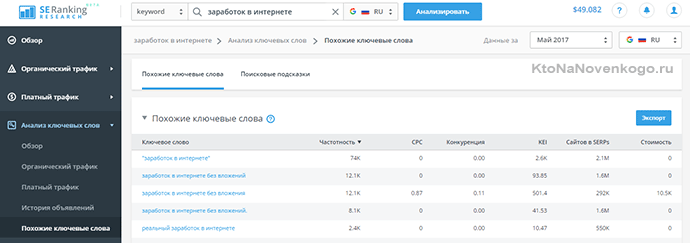

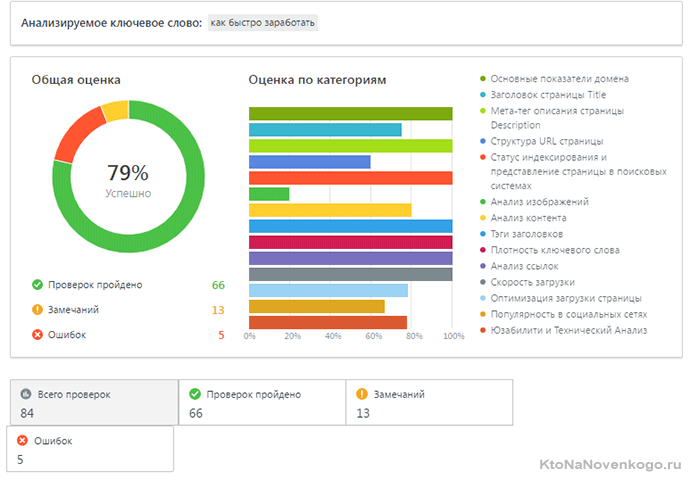

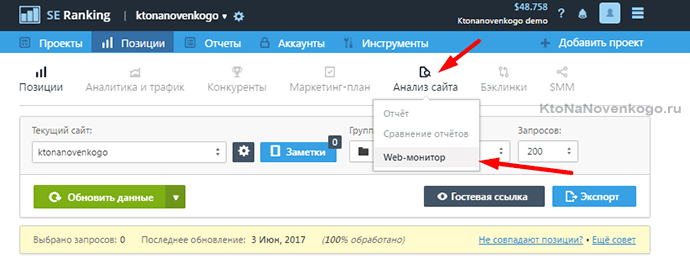

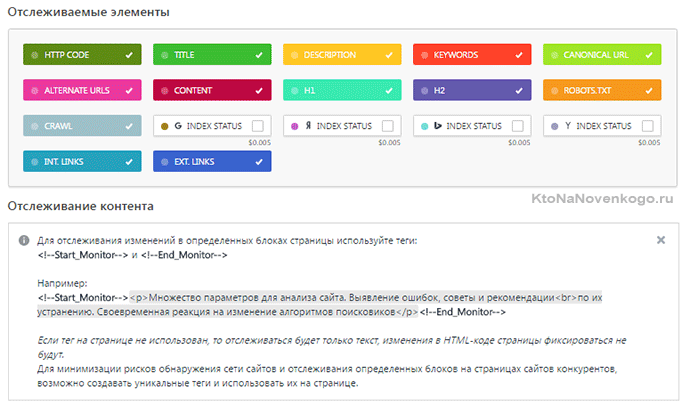

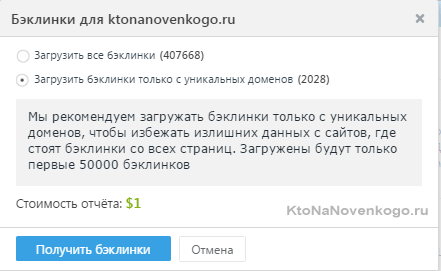

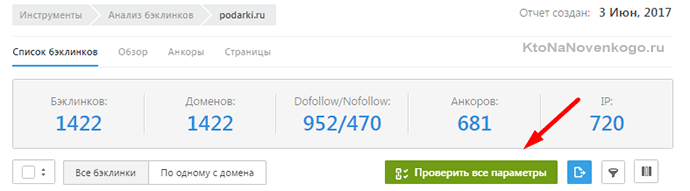

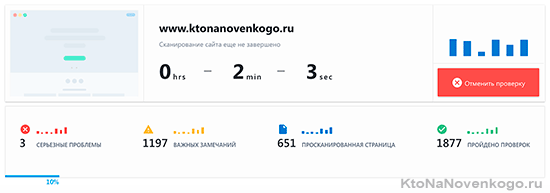

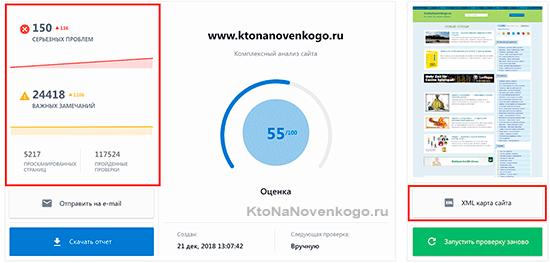

SE Ranking — как автоматически проверять позиции и находить ошибки

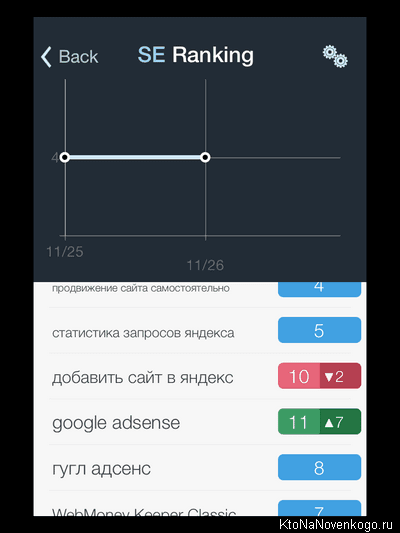

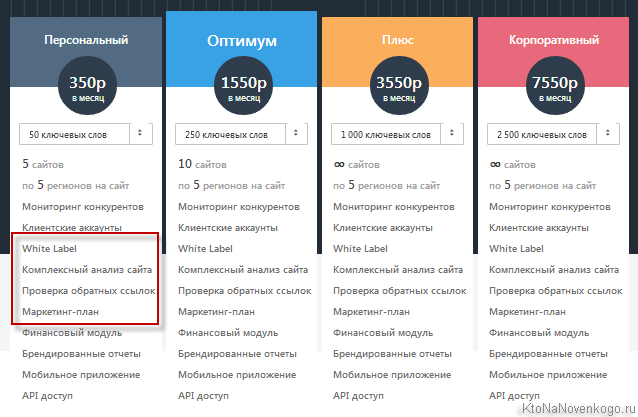

Сегодня хочу поговорить про один из вариантов проверки позиций, занимаемых сайтом в той или иной поисковой системе, в том или ином регионе России или даже мира. Сайты бывают разные: коммерческие и региональные или же информационные, которым регион совсем не важен, но наш сегодняшний герой удовлетворит потребности их всех.

Не всегда и не у всех найдется время, чтобы тратить его на ручной съем позиций. К тому же, эта надоедливая капча... Удобно, когда статистика обновляется ежедневно и автоматически, когда можно видеть динамику по сравнению со вчерашним днем или месяцем, когда все это богатство можно повертеть в руках и посмотреть на графиках. В общем, пришло время сделать шаг вперед.

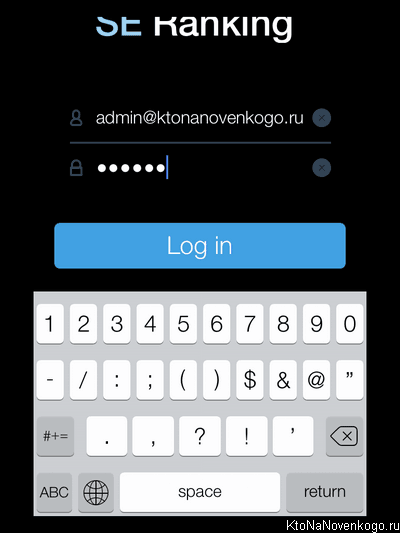

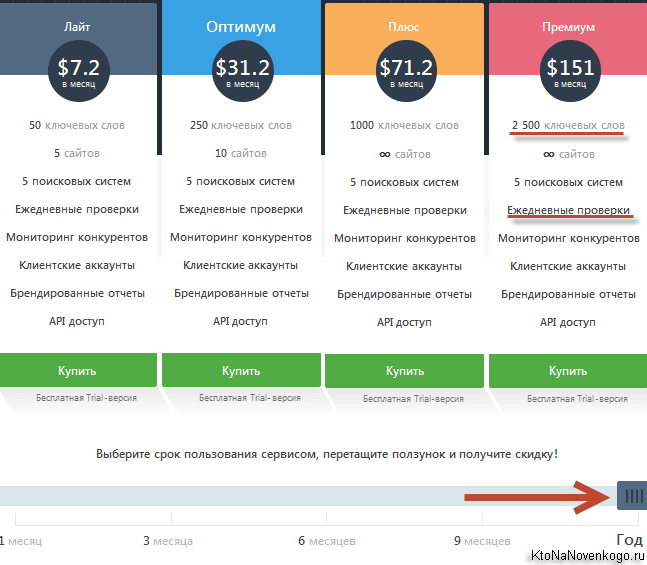

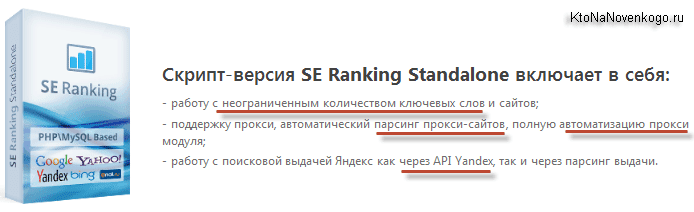

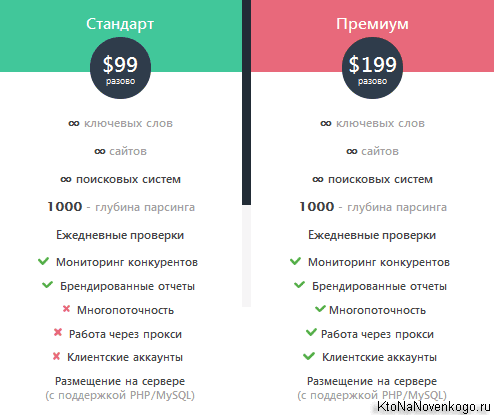

Кроме этого у них есть возможность использовать онлайн проверку позиций (имеется в арсенале даже приложение для мобильных устройств), а можно установить скрипт себе на сервер и вообще забыть про какие либо ограничения на количество и глубину пробиваемых позиций.

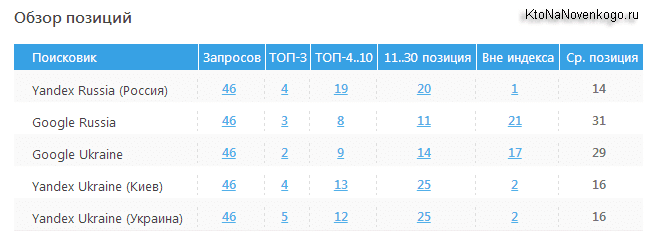

Причем позиции можно отслеживать не только в Яндексе и Гугле, но и в Бинге и в Яху, и для каждой поисковой системы можно будет выбрать любой доступный ей регион по всему рунету (вплоть до города) и даже миру (тем, кто делает сайты для буржунета, последнее будет актуально).

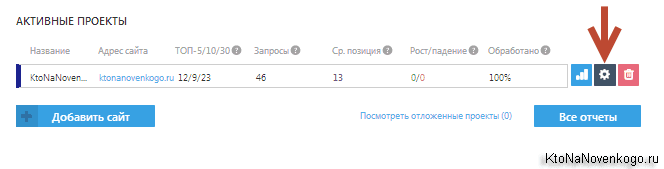

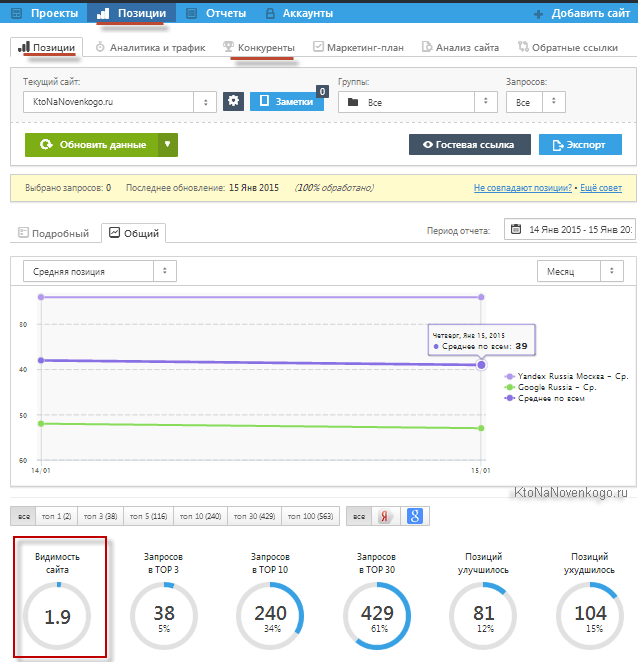

Возможности SE Ranking по съему позиций и их анализу

Что дает SE Ranking оптимизатору или же обычному владельцу сайта, который прикладывает усилия к его раскрутке и хочет своевременно отслеживать результаты предпринятых им действий:

- Выбор между двумя видами сервиса: онлайн и скрипт.

- В первом случае, заботу о смене IP адресов, при запросе к поисковым системам и практически мгновенной съеме позиций, берет на себя SE Ranking (используются его прокси и его сервера в облаке), но при этом существует предельное число запросов, которые можно будет пробивать таким образом.

- При использовании скрипта, который устанавливается на хостинг пользователя, все ограничения по количеству запросов, числу отслеживаемых сайтов и глубине их пробития снимаются, но вот прокси уже вам придется настраивать самим, да и нагрузку вы будете создавать при проверке позиций именно на сервер своего хостинга.

Большинство пользователей ориентированы на поисковые системы России, Украины, Беларуси (рунета), где правят бал Google и Яндекс, поэтому SE Ranking умеет снимать позиции отдельно для любого региона этих стран (вплоть до города) в любой из основных поисковых систем (Яндекс, Гугл, Бинг, Яху).

Но далеко не все сайты ориентированы на рунет, ибо в буржунете трафика намного больше, а значит больше возможностей для заработка, поэтому данный сервис позволяет пробивать, например, выдачу по Гуглу для любой страны мира.

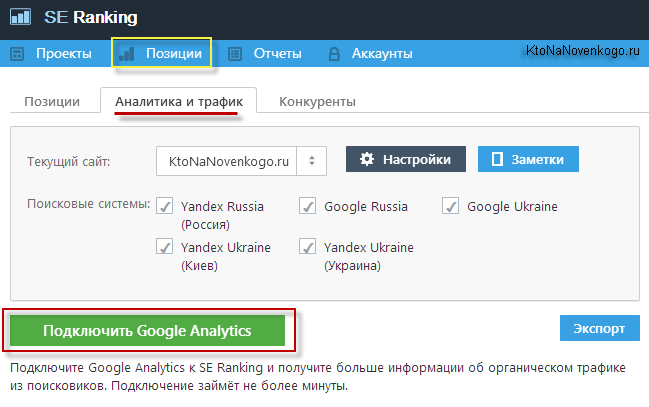

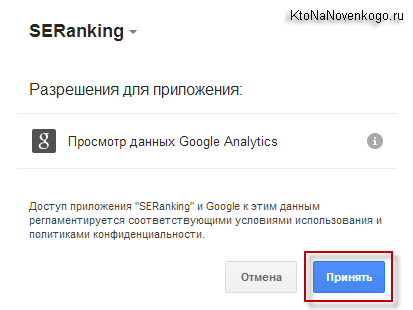

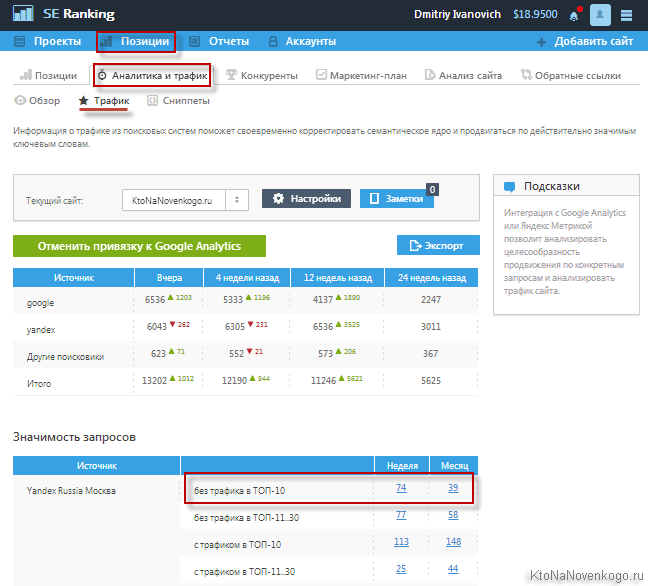

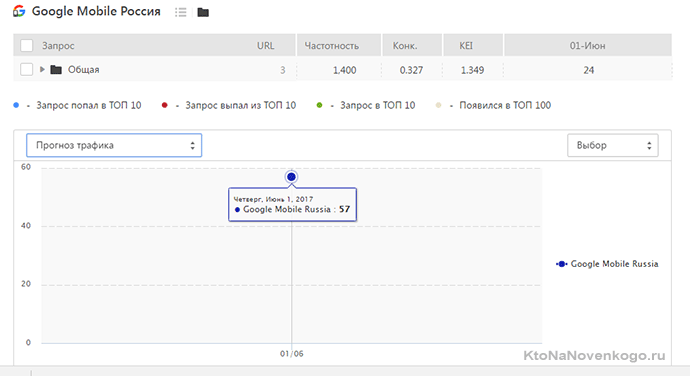

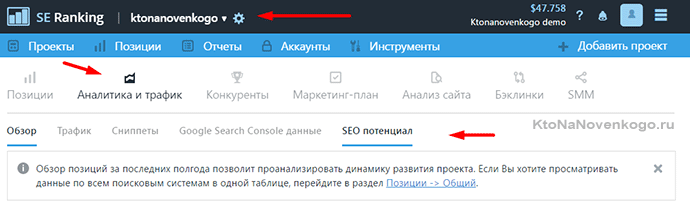

- Мне понравилась возможность привязать Гугл Аналитикс к этому сервису и получать дополнительные полезные данные для анализа. Например, вместе с позициями по запросам (и их динамикой) показывается тот трафик, что можно будет привлечь именно в том регионе, который интересует пользователя.

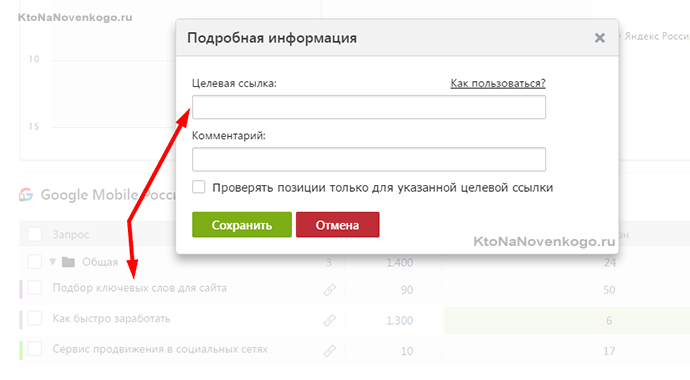

- Для каждого запроса и выбранной поисковой системы SE Ranking показывает ссылку на релевантную страницу, что довольно удобно.

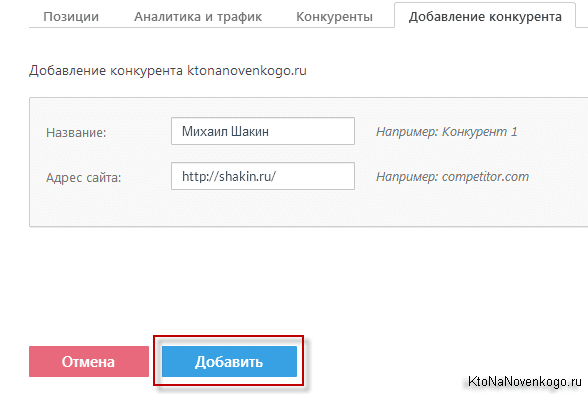

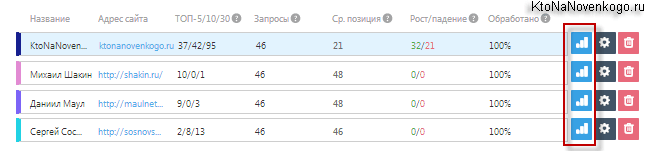

- Если у вас есть конкуренты, то актуально будет отслеживать и их позиции по тем же самым поисковым запросам, которые пробиваете вы сами. Можно будет отследить эффективность их действий направленных на продвижение и опираться на эту информацию при собственной раскрутке. Для каждого проекта можно добавить пяток сайтов конкурентов

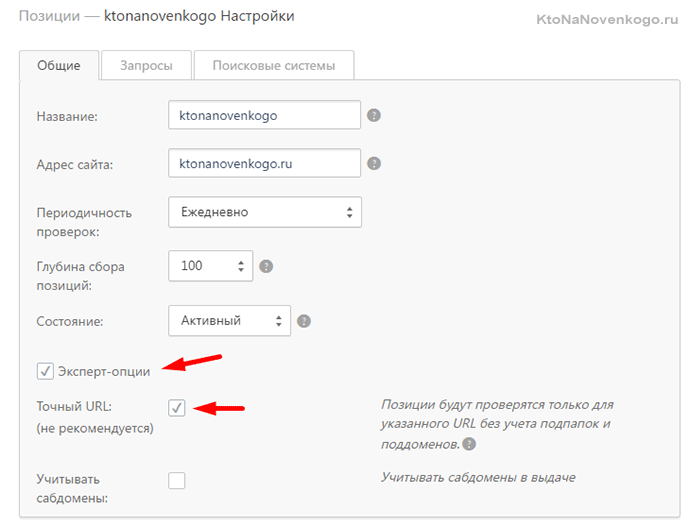

- Упомянутый чуть выше Сайт-аудитор пробивает первые пятьдесят позиций в выдаче в поисках вашего ресурса. Иногда этого достаточно, а иногда нет. Данный сервис позволяет задавать глубина сбора позиции, которая варьируется вплоть до 300 в случае онлайн сервиса и до 1000 — в случае использования скрипта.

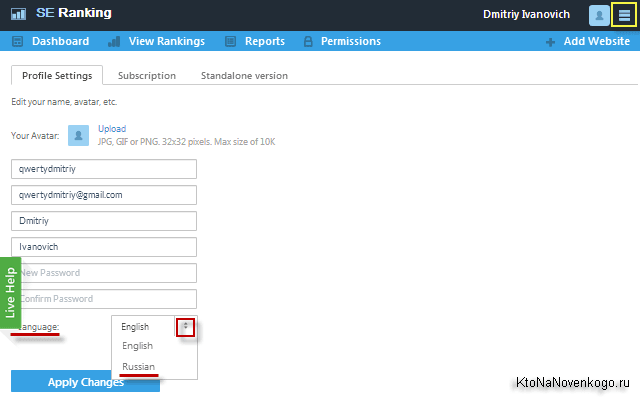

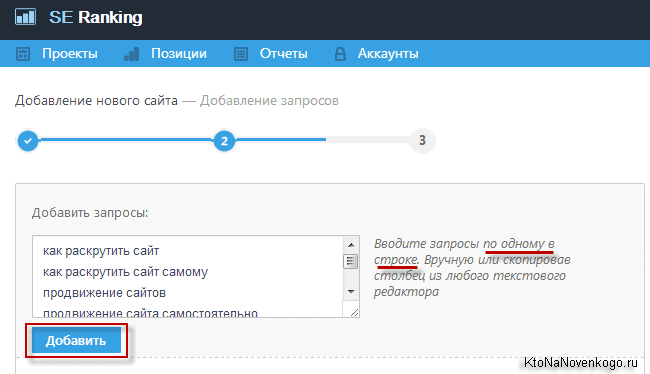

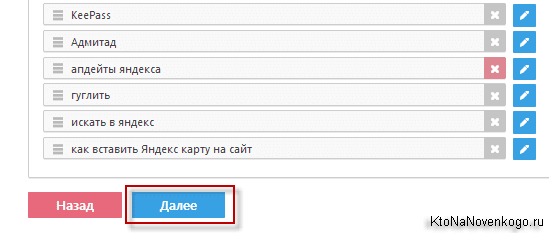

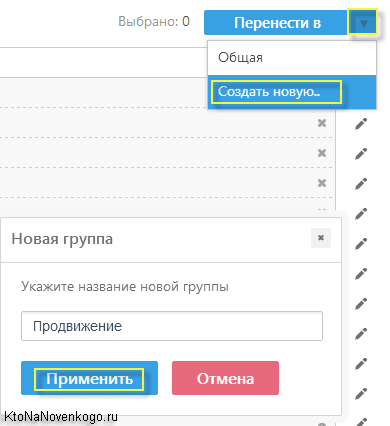

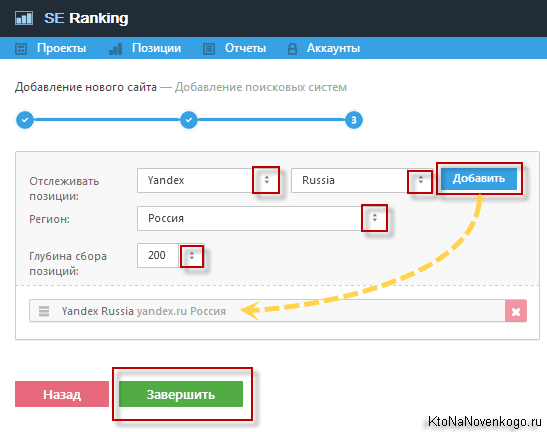

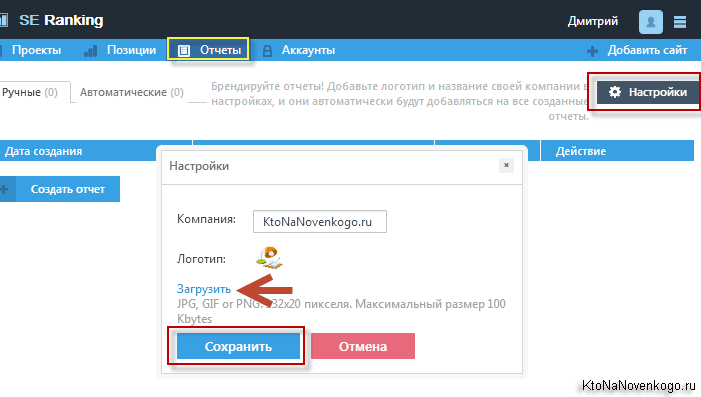

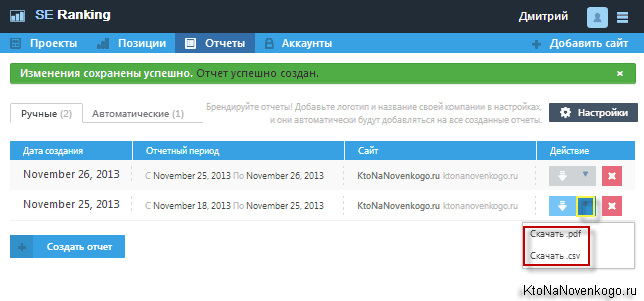

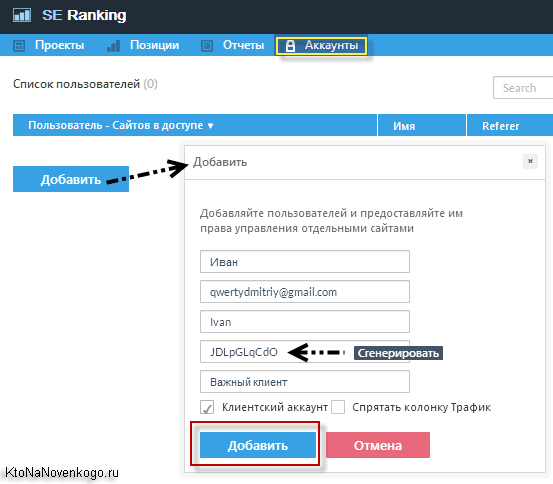

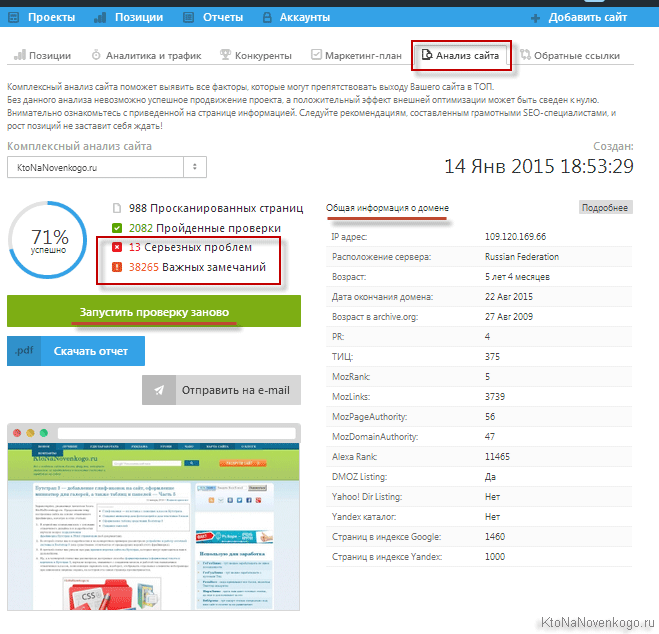

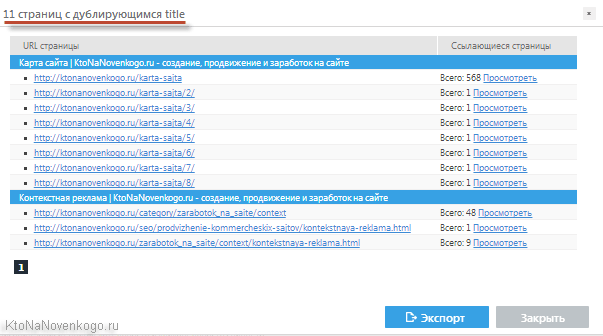

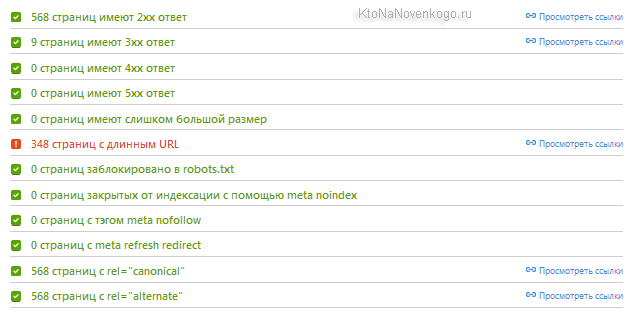

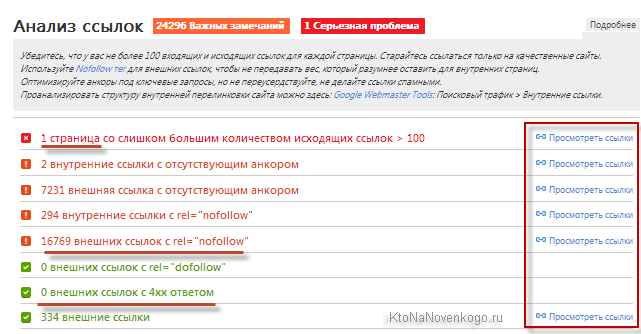

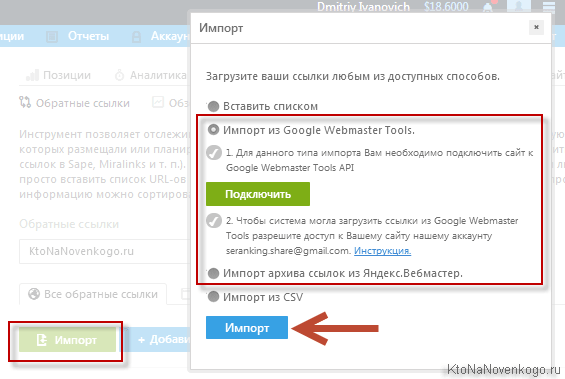

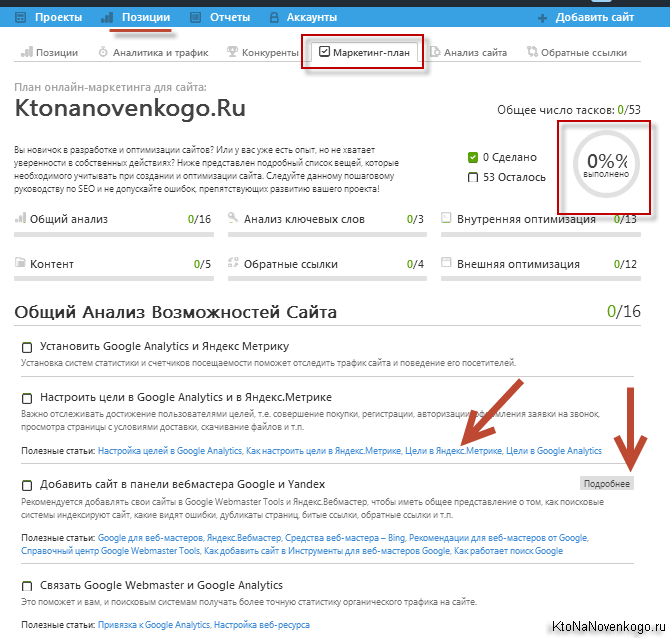

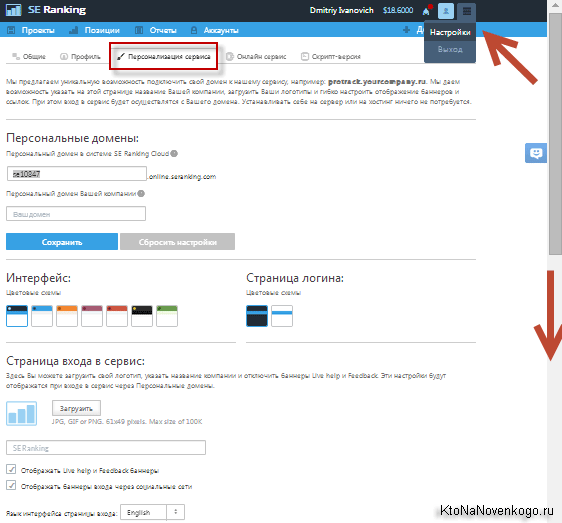

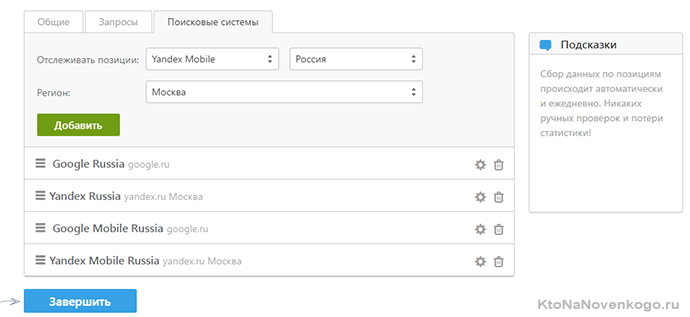

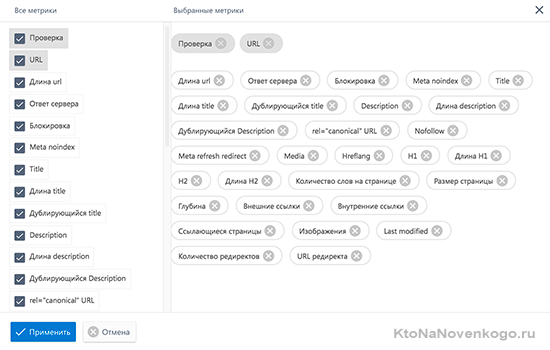

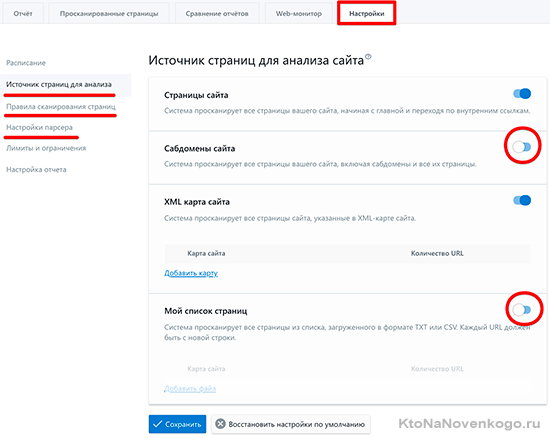

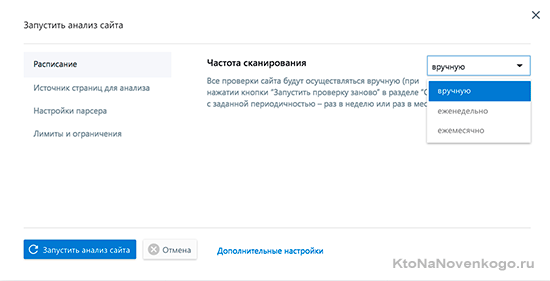

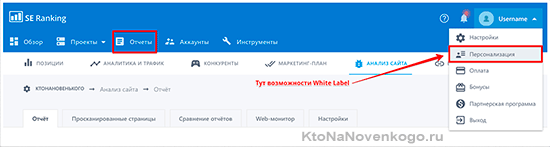

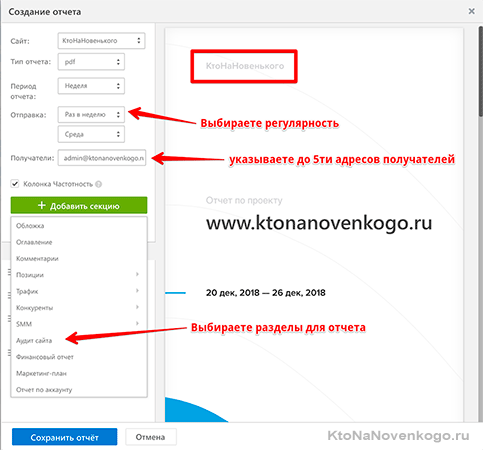

- На основе полученных данных, в SE Ranking можно будет вручную или автоматически формировать отчеты в формате PDF, CSV или Excel. Вы сами задаете, что именно должно быть в отчете, также имеется возможность добавить на них свое лого, что может быть актуально для SEO компании, передающей отчет клиенту. Им же будет полезна и возможность предоставления гостевого доступа к определенному проекту, чтобы заказчик мог сам просматривать позиции своего сайта (оценивать работу оптимизатора).